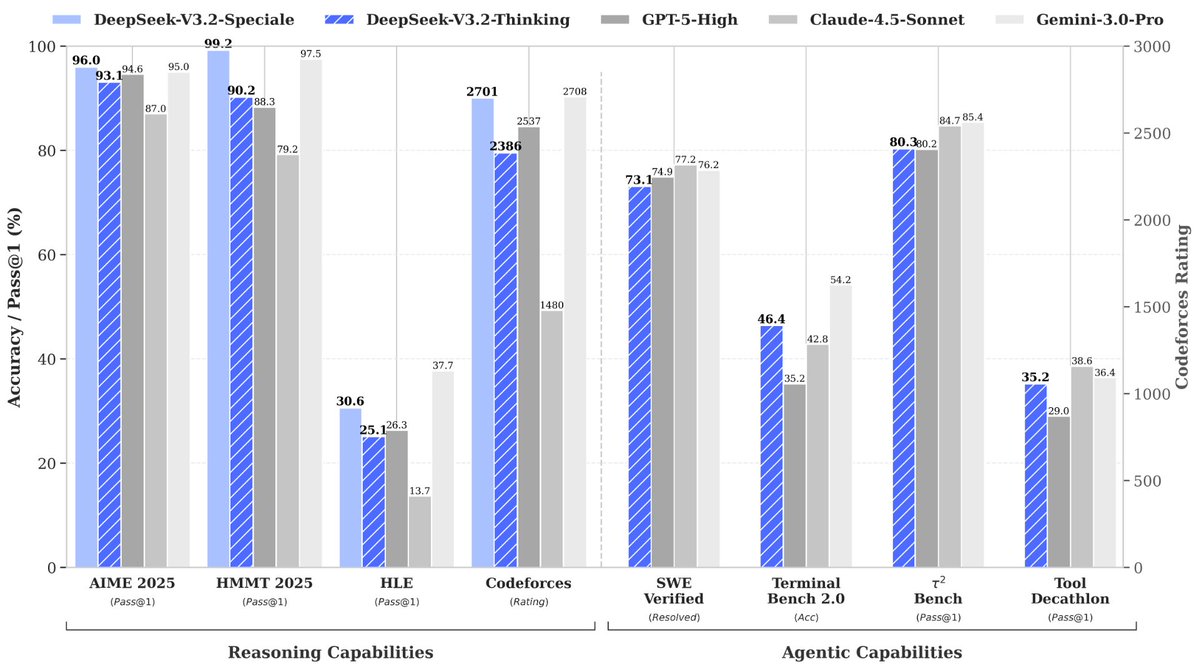

A DeepSeek acaba de lançar seu modelo mais recente, a versão 3.2, que se concentra em inferência eficiente e recursos poderosos para os agentes. A introdução do mecanismo de Atenção Esparsa (DSA) reduz significativamente a complexidade computacional, mantendo o desempenho do modelo, e é especificamente otimizada para cenários de contexto longo. Um avanço significativo foi alcançado na síntese de tarefas de agentes em larga escala, integrando capacidades de raciocínio em cenários de invocação de ferramentas e melhorando consideravelmente o desempenho do modelo em ambientes interativos complexos. Endereço do modelo: https://t.co/VwGFgEylOz Simultaneamente, foi lançada uma versão aprimorada, DeepSeek-V3.2-Speciale, cujo desempenho se mostrou ainda mais notável. Com o suporte da estrutura de aprendizado por reforço, sua capacidade de raciocínio é considerada superior à do GPT-5 e comparável à do Gemini-3.0-pro, tendo conquistado medalhas de ouro em competições internacionais como a IMO 2025 e a IOI. Endereço do modelo: https://t.co/yWt5pX9UH2 Além disso, o modelo de bate-papo foi atualizado para oferecer suporte ao recurso "pensar com ferramentas", e uma nova função de desenvolvedor foi adicionada especificamente para o agente de busca. No geral, essa atualização do DeepSeek é bastante substancial e merece atenção.

Carregando detalhes do thread

Buscando os tweets originais no X para montar uma leitura limpa.

Isso normalmente leva apenas alguns segundos.