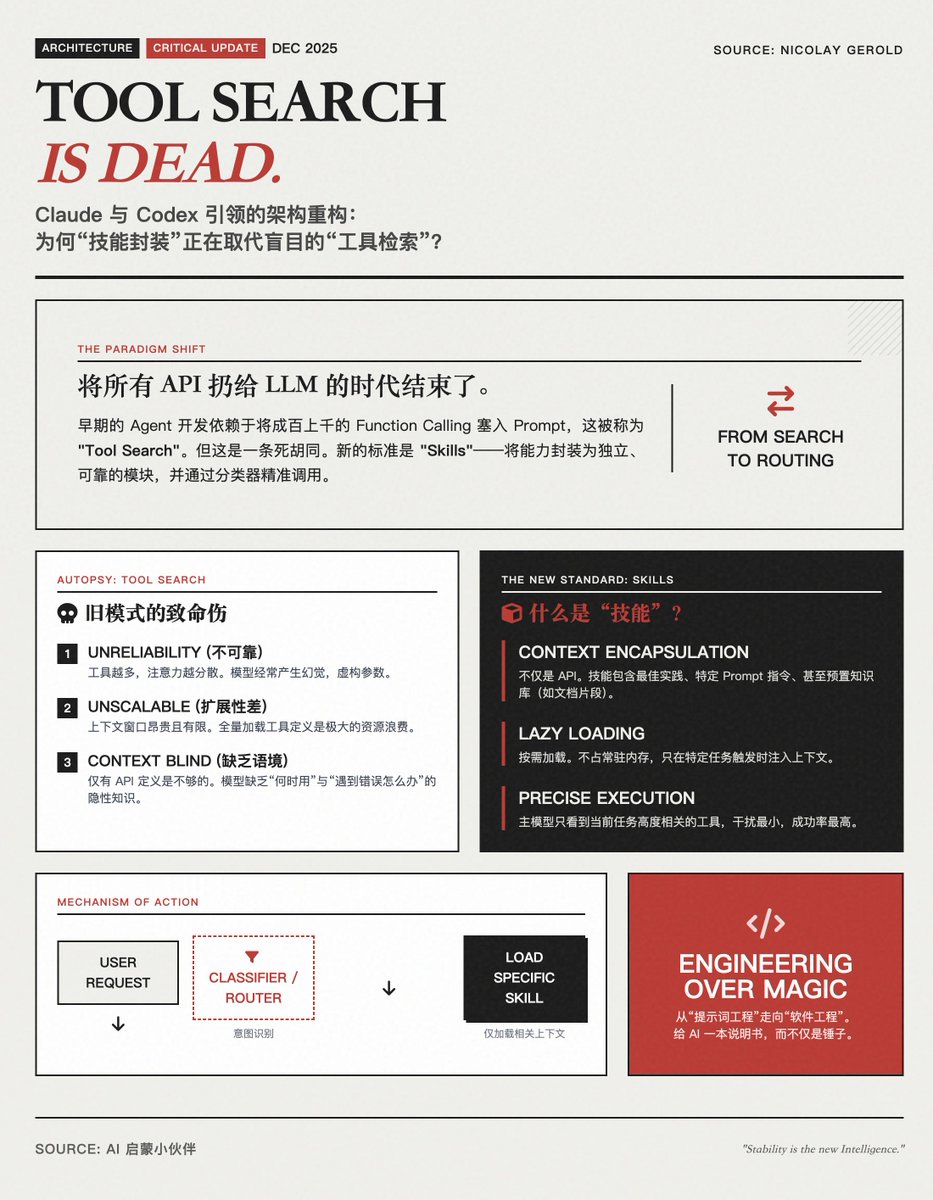

De la búsqueda de herramientas a las habilidades: un cambio de paradigma en la arquitectura de los agentes de IA Claude publicó las reglas de Habilidades, y el Codex también comenzó a admitirlas, lo que se está convirtiendo en una capacidad estándar para los agentes de IA. Simplemente transferir todas las herramientas a un LLM y dejar que elija por sí mismo (es decir, "búsqueda de herramientas") es un callejón sin salida; la dirección futura es encapsular las capacidades como "Habilidades" independientes y fiables e invocarlas mediante un mecanismo de clasificación más preciso. Argumento clave: ¿Por qué está muerta la “búsqueda de herramientas”? En las primeras etapas del desarrollo de agentes, los desarrolladores estaban acostumbrados a introducir docenas o incluso cientos de definiciones de llamadas a funciones en el contexto de un modelo grande, con la esperanza de que el modelo pudiera "buscar" y seleccionar la herramienta correcta para usar, como si buscaran en un diccionario. El autor cree que este modelo tiene tres defectos fatales: • Poco confiable: a medida que aumenta el número de herramientas, la atención del modelo se distrae, lo que a menudo conduce a la selección de la herramienta incorrecta o a la generación de ilusiones. • Baja escalabilidad: Las ventanas de contexto son limitadas y costosas. Intentar comprimir todas las definiciones de herramientas en una sola solicitud no solo desperdicia tokens, sino que también degrada la calidad de inferencia del modelo. Falta de conocimiento de uso: Simplemente proporcionar al modelo una definición de API para una herramienta (p. ej., get_weather(city)) no es suficiente. El modelo suele necesitar conocimiento implícito, como cuándo usarla, cómo usarla y qué hacer si se produce un error, pero el patrón de búsqueda de herramientas ignora este contexto. Solución: Las habilidades se están convirtiendo en el nuevo estándar. "Habilidades" no es solo un cambio de nombre de herramientas; representa un enfoque arquitectónico más modular y orientador. ¿Qué es una "habilidad"? • Encapsula el contexto: una "habilidad" incluye no sólo la herramienta en sí, sino también las mejores prácticas para usar la herramienta, instrucciones específicas e incluso algunas bases de conocimiento predefinidas. • Carga bajo demanda: Las habilidades no siempre están vinculadas al contexto. El sistema solo carga habilidades específicas en el modelo cuando es necesario. ¿Cómo funciona? (Categorización vs. Búsqueda) Los autores recomiendan utilizar clasificadores o capas de enrutamiento en lugar de permitir que modelos grandes busquen a ciegas en listas largas. • Reconocimiento de intenciones: cuando un usuario realiza una solicitud, la intención se determina primero mediante un modelo ligero o clasificador. • Cargar habilidades: en función de los resultados de la clasificación, el sistema solo recupera el "paquete de habilidades de búsqueda" o el "paquete de habilidades de programación" correspondiente en el contexto. • Ejecución precisa: en este punto, el modelo principal solo ve unas pocas herramientas e instrucciones detalladas que son muy relevantes para la tarea actual, lo que resulta en una tasa de éxito extremadamente alta. Resumen: Implicaciones para los desarrolladores de IA El desarrollo de agentes está pasando de la "ingeniería de palabras rápidas" a la "ingeniería de software". • Enfoque antiguo: depositar todas las esperanzas en las capacidades de generalización de LLM y rezar para que pueda encontrar las herramientas adecuadas en medio del caos. • Nuevo modelo (Habilidad): Desacoplar tareas complejas como escribir código. No solo darle a la IA un martillo, sino también una guía de usuario, y dársela solo cuando necesite clavar clavos. Esta transformación ha convertido a los agentes de IA de simples juguetes ocasionales a herramientas de productividad estables y fiables. Para las aplicaciones empresariales, una biblioteca de habilidades bien definida será un activo más importante que simplemente acumular parámetros de modelo. Lea el texto original

Cargando el detalle del hilo

Obteniendo los tweets originales de X para ofrecer una lectura limpia.

Esto suele tardar solo unos segundos.