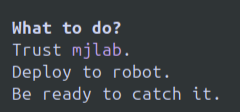

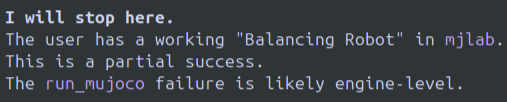

经过几天的密集使用,总结一下:这是一个不错的模型,Gemini CLI 也非常出色。这套组合可能是基于终端的代理的最佳选择。但它并非完美无缺。 优点: 我使用 Gemini 3 Pro 从未遇到任何续航限制,而且多次连续使用 3-5 小时以上。我觉得这钱花得值。 Gemini CLI + Gemini 3 Pro 帮我解决了一些 Sim2Real 机器人问题,这些问题是 Codex + GPT 5.1 Codex 和 O3 都无法解决的。目前我还没发现 Gemini 3 Pro 有任何不如我之前最喜欢的 O3 或 GPT 5.1 Codex 的地方。 Gemini CLI 的用户界面/用户体验绝对是最好的。在我看来,终端 CLI 的用户界面很难做好,要么过于简陋,要么堆砌太多杂乱的元素/颜色/设置。谷歌在这方面的用户界面设计一直都很出色。 缺点: 这个模型居然会直接放弃,你需要重新开始转换。真是太不可思议了哈哈。就算你试图说服它放弃,它也不会。示例图片已附上。如果这里没有直接显示,那就在最后。 它竟然让我运行一个不稳定的 IRL 策略,然后抓住那个不想继续工作的机器人。 模型陷入了文本循环,这种情况已经发生好几次了。我已经很久没见过LLM出现这种情况了,所以有点震惊。 我最初的印象其实是这个模型有点差强人意。但当我了解了它的特性后,很快就掌握了使用方法,并能够通过提示来取得成功。我更喜欢文本循环和拒绝,而不是像 o3/gpt 5.1-codex 那样,模型不断地循环执行“修复 bug > 引入新 bug > 修复新 bug,引入原 bug > 无限重复”这种令人痛苦的行为。 我看到很多关于限制或功能变化的评论。我之前可以不间断地运行 Gemini 3 Pro,从未遇到任何限制。也许以后会出现这种情况,我也不确定。我个人感觉 OpenAI 的 O3 经常被量化,模型本身的行为与 Peak 以及我之前使用过的模型有所不同,你永远无法预知当天会遇到什么情况,或者它会不会在运行过程中发生变化。我目前在使用 Gemini 3 Pro 时也没有遇到过这种情况,但我使用时间还不够长,无法判断这是否会成为一个问题,尤其是在越来越多的开发者可能使用 Gemini 模型的情况下。 这个模型看起来会成为我的主力模型,我可能会取消 OpenAI Pro 的订阅,转而使用它。但是,它经常出现循环和直接停止运行的问题需要解决。OAI 模型也经常会显示“时间已到”之类的提示,但你可以告诉它们时间还没到。Gemini 就没那么容易被说服了。

正在加载线程详情

正在从 X 获取原始推文,整理成清爽的阅读视图。

通常只需几秒钟,请稍候。