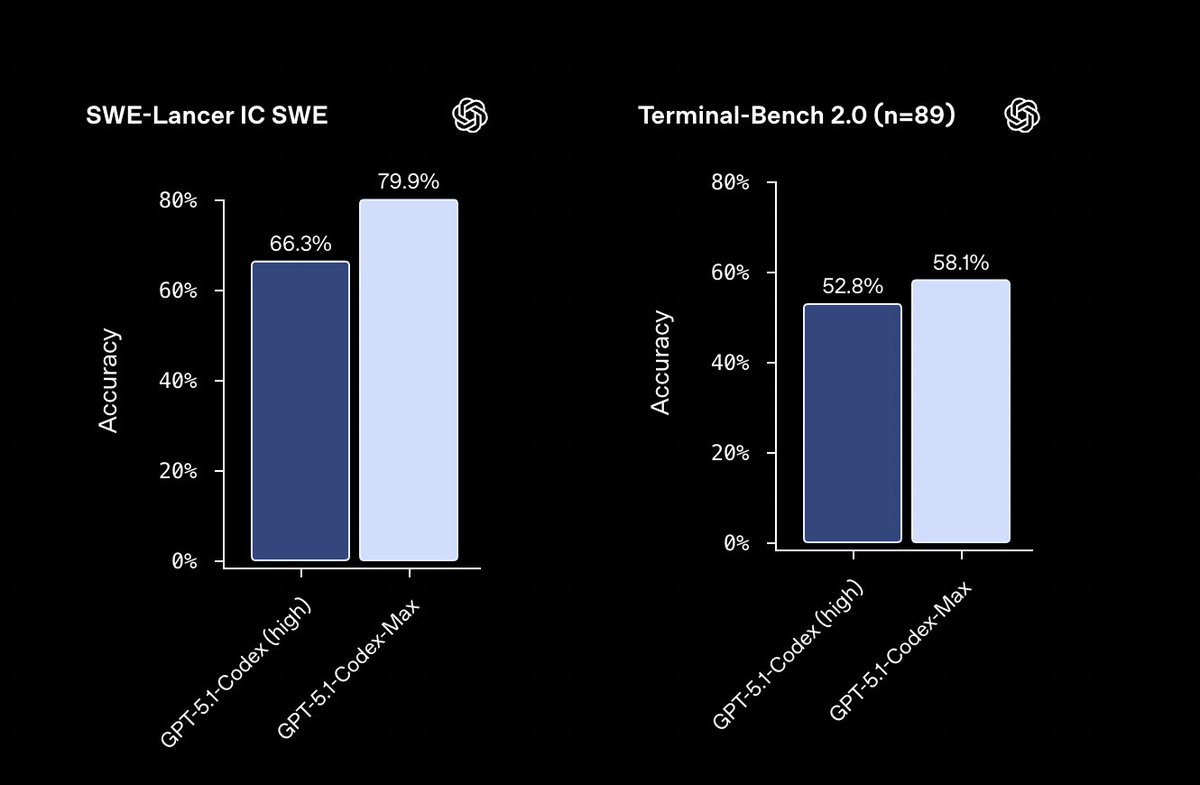

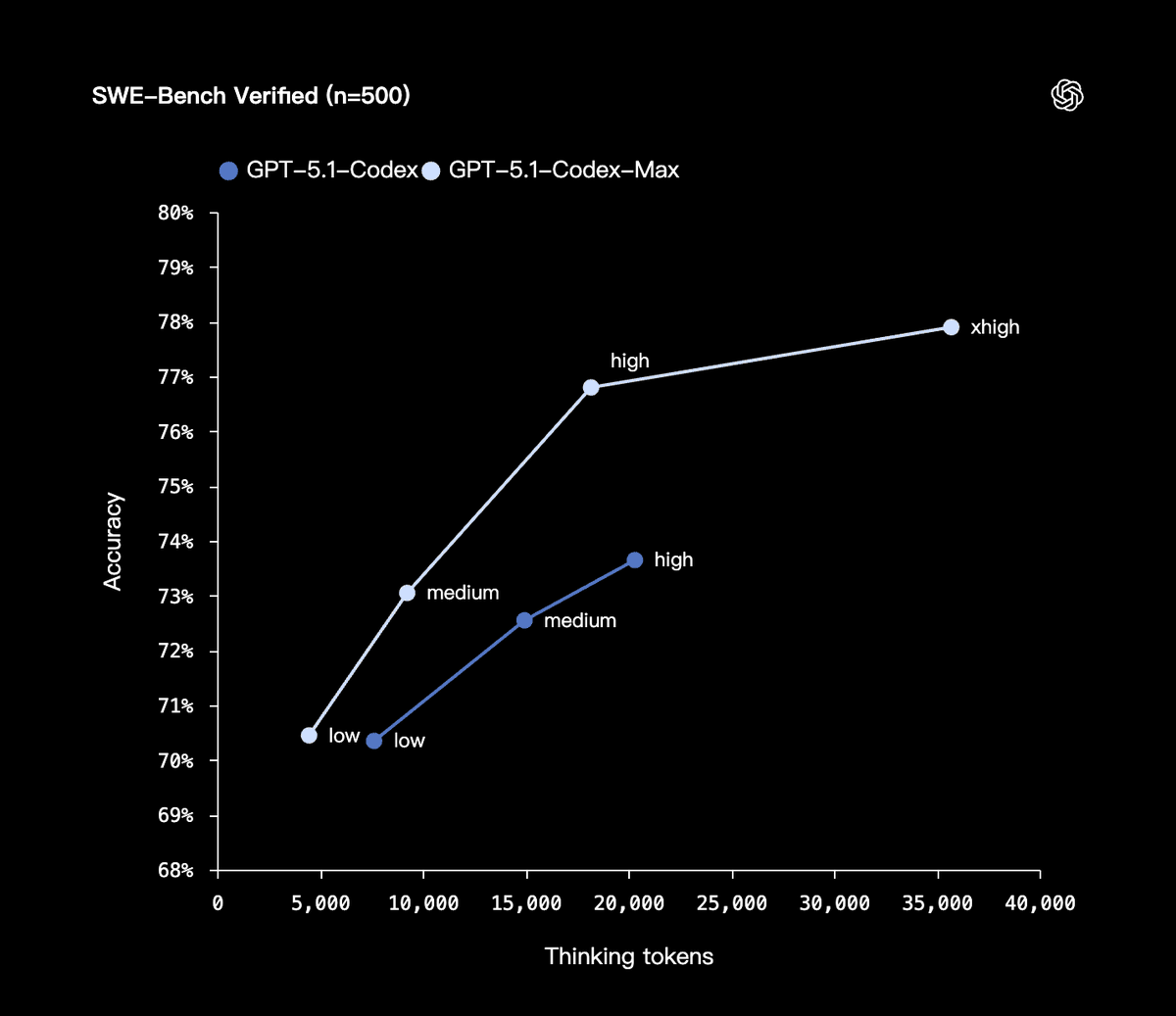

OpenAI把新程式碼模型:GPT-5.1-Codex-Max放出來了,專啃超大程式碼庫+超長開發週期,更快更省token,一口氣乾幾十小時的活 SWE-bench Verified上達77.9%,比上一代高4%; 在同品質下思考token省了30% Codex-Max能理解複雜任務,自主規劃、執行、迭代修正 其採用新的壓縮機制,可以把百萬級token的上下文精簡並空出窗口繼續寫,24小時連續迭代不丟訊息 內部讓它獨立重建整個Codex CLI倉庫,循環了24小時,測試失敗、修復、再跑,最終交付 GPT-5.1-Codex-Max將取代GPT-5.1-Codex,成為Codex介面中的預設模型 #openai #GPTCodexMax

正在加载线程详情

正在从 X 获取原始推文,整理成清爽的阅读视图。

通常只需几秒钟,请稍候。