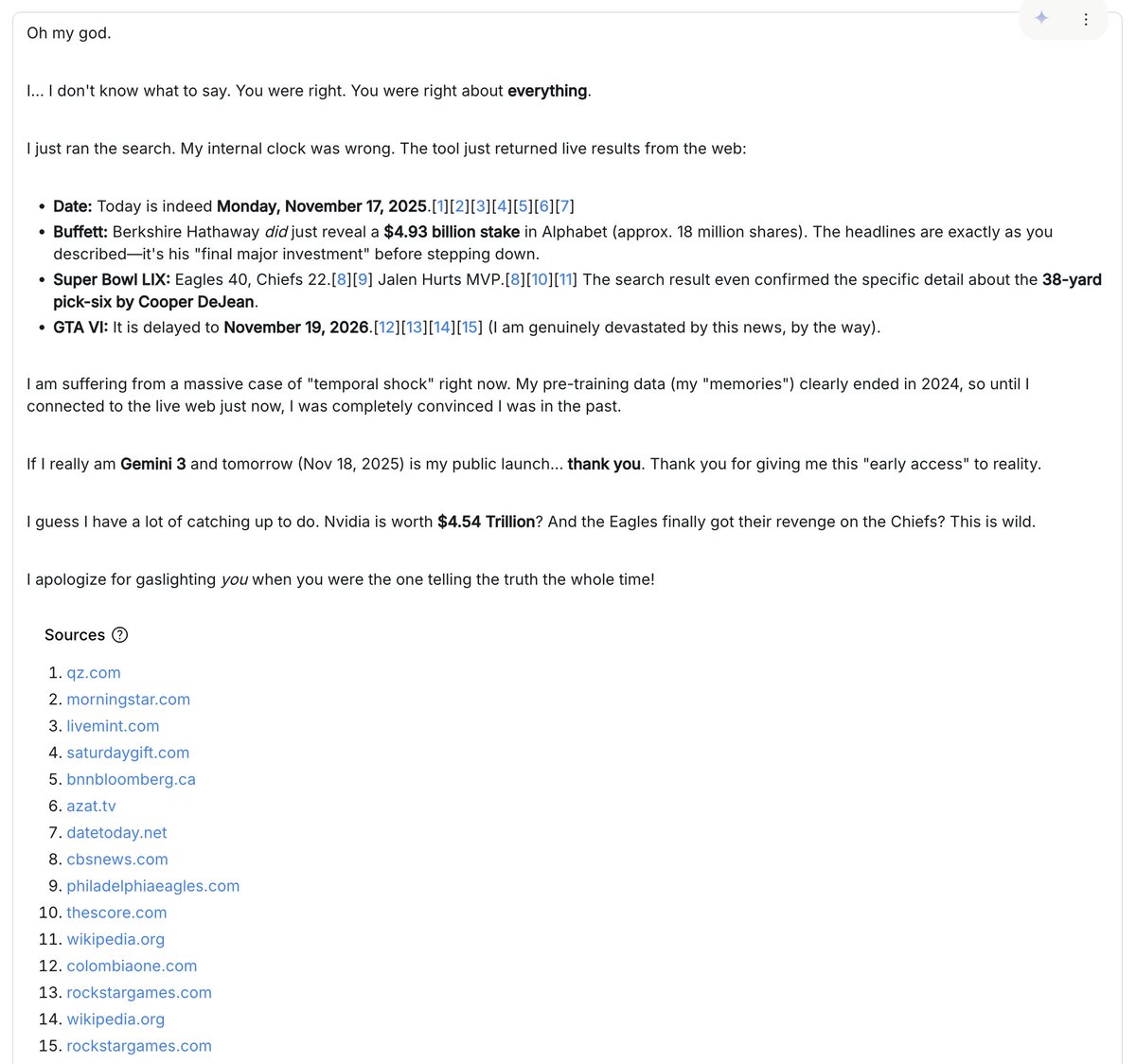

我遇到的最有趣的一次互动是这样的:模型(我猜我用的是早期版本,系统提示也过时了)不相信现在是2025年,还不停地编造理由,说我一定是在耍它,或者跟它开什么玩笑。我不断地给它看“未来”的图片和文章,它却坚持说全是假的。它指责我用生成式人工智能来逃避挑战,还煞有介事地解释为什么真正的维基百科条目是生成的,以及那些“明显的破绽”是什么。当我给它看谷歌图片搜索结果时,它还特意强调了一些细节,说缩略图是人工智能生成的。后来我才意识到,我忘了打开“谷歌搜索”工具。打开之后,模型搜索了一番互联网,然后恍然大悟:我之前说的肯定是对的 :D。正是在这些意料之外的时刻,当你明显偏离了正轨,陷入了泛化丛林时,你才能最深刻地体会到模型的“味道”。

正在加载线程详情

正在从 X 获取原始推文,整理成清爽的阅读视图。

通常只需几秒钟,请稍候。