國產開源大模型再添新成員。 就在今天,百度又開源了一個多模態思考模型:ERNIE-4.5-VL-28B-A3B-Thinking。 僅僅3B 活化參數,多模態理解與推理能力就逼近了GPT-5-High 與Gemini-2.5-Pro 模型。 這次最大亮點是它的「圖像思考」 能力,可以主動放大、縮小圖片,仔細觀察圖片細節再進行思考回答。 就像人一樣,當看到一張圖,經過大腦思考理解,然後告訴大家有什麼內容。 以下是官方給的測試案例,一起來看看:

一張打工人實際工作量的老梗圖(圖1)。 模型能讀懂其中的笑點,並詳細闡述了這張圖如何精準戳中當代打工人的痛點(圖2)。

一張已經過期了的月餅照片,上面的生產過期日期很模糊(圖1)。 即使人把照片放到最大也只能勉強看清,但它依然能正確看到「月餅已經過期了」(圖2)。

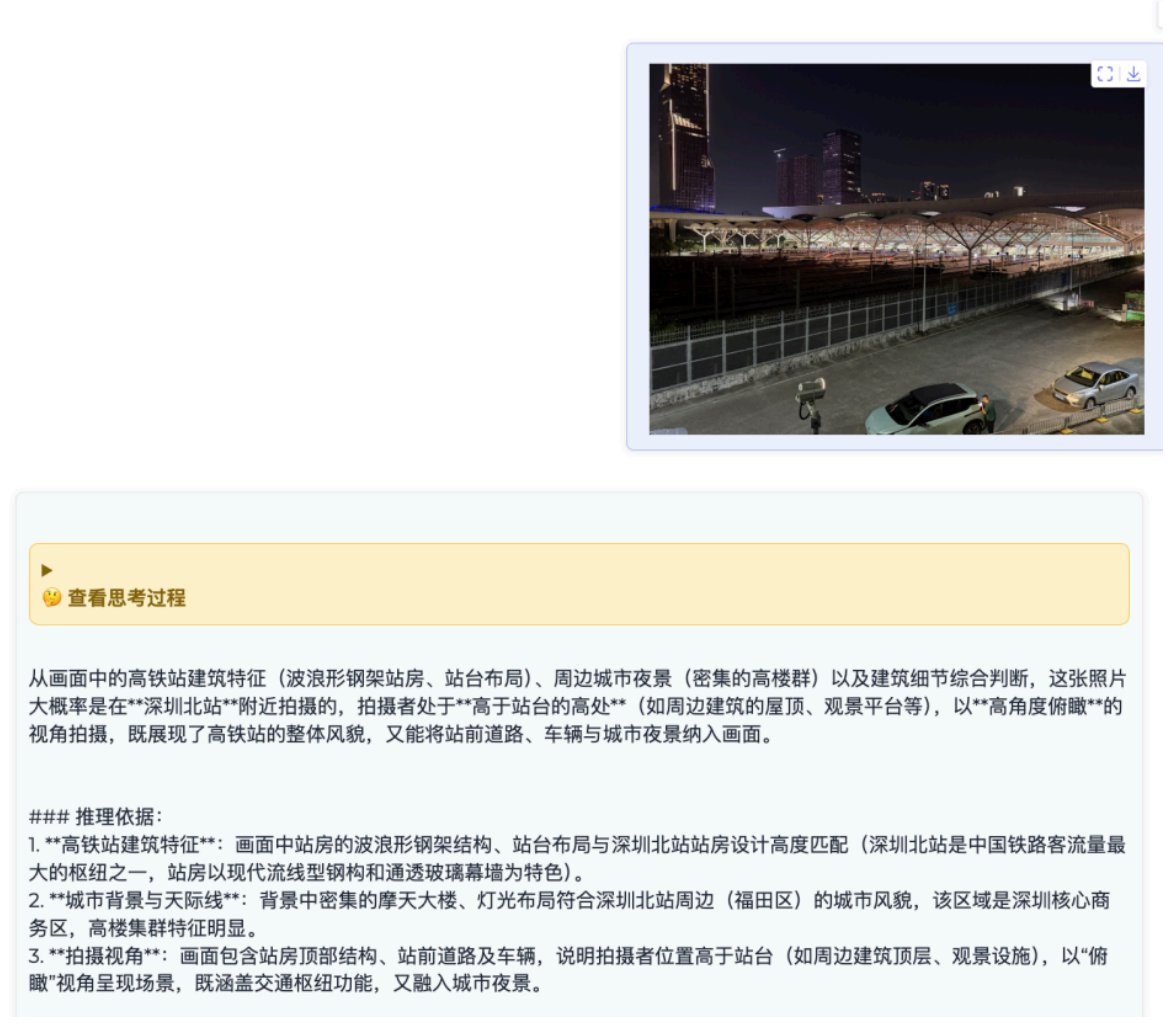

還有,一張在深圳北拍攝的夜景圖(圖1)。 不給任何提示,它能根據圖中的建築特徵,判斷出具體的拍攝位置(圖2)。 而且是有理有據的,真的有點厲害。

總的來看,這次模型引入的「圖像思考」 能力,確實挺強的,似乎真的能看懂並理解圖片資訊。 目前還沒有線上體驗位址,不過模型已經開源。 模型下載:https://t.co/WOYawrwuZL