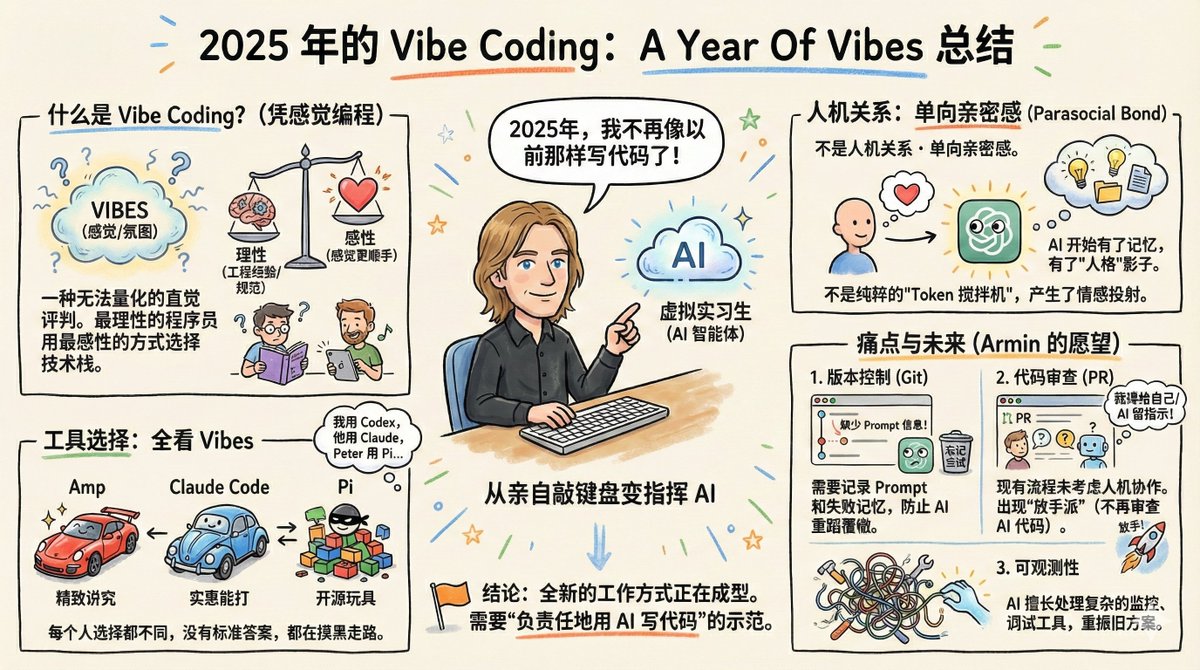

Acabei de ler um artigo intitulado "Um Ano de Boas Vibrações", que é um resumo bastante representativo da Programação de Vibrações ao longo do último ano. Muitas pessoas podem não estar familiarizadas com o autor Armin Ronacher, mas se você já usou Python, provavelmente já utilizou um trabalho dele — o framework Flask, que ele criou há mais de uma década. A primeira frase do documento me impactou profundamente: Em 2025, não escreverei mais código da mesma forma que antes. De forma semelhante à sua experiência, uma pessoa que programa há quase vinte anos agora transforma seu trabalho principal em orientar uma IA a escrever código. Ele compara isso a passar de um "programador que digita pessoalmente no teclado" para um "líder técnico de um estagiário virtual". Minha própria transição para a Programação Vibe veio do Claude Code, assim como a dele. Por volta de abril ou maio deste ano, ele se aprofundou no uso do Claude Code. Ao longo de alguns meses, publicou 36 artigos em seu blog, representando 18% de todos os artigos publicados desde 2007. Isso não aconteceu porque ele tinha mais tempo livre, mas sim porque a IA o libertou do tedioso trabalho de implementação. Atualmente, ele usa três ferramentas de programação de IA simultaneamente: Amp, Claude Code e Pi. Ele comparou essas três ferramentas a Porsches — refinadas e sofisticadas; o Claude Code é como um Volkswagen — acessível e poderoso; e o Pi é um brinquedo de código aberto para hackers. Três ferramentas, três estilos distintos, mas ele não saberia dizer qual é a melhor. Eu, pessoalmente, uso principalmente o Codex, complementado pelo GitHub Copilot e pelo Claude Code. Estimo que, se fosse realizada uma pesquisa, todos escolheriam ferramentas de programação de IA diferentes, porque todos estão usando "intuição". A palavra "Vibes" aparece ao longo do artigo e é também a origem do título. Literalmente, significa "atmosfera" ou "sentimento", mas aqui se refere a um critério de julgamento que não pode ser quantificado e só pode ser sentido intuitivamente. Talvez o aspecto mais estranho da programação de IA em 2025 seja o seguinte: a experiência em engenharia acumulada ao longo de cinquenta anos em um setor torna-se repentinamente menos eficaz. Os padrões de código e as melhores práticas, quando confrontados com código gerado por IA, acabam se baseando em uma espécie de misticismo — este modelo "parece" mais confortável, aquela ferramenta "parece" mais fácil de usar. O grupo de programadores mais racional está agora escolhendo seu conjunto de tecnologias da maneira mais emocional possível. Armin vinha tendo dificuldades com o MCP (Model Context Protocol) há um ano inteiro, considerando-o pouco confiável. No entanto, ele não tinha dados para comprovar isso, apenas conseguia dizer: "De qualquer forma, não funciona para mim". Enquanto isso, outros o utilizavam com entusiasmo. Seu amigo Peter, que o apresentara a Claude no início do ano, agora usava o Codex e o considerava excelente. Armin experimentou, mas não o achou tão atraente. Quem está certo e quem está errado? Não há resposta. Todos estão tateando no escuro. Uma sensação mais profunda de inquietação surge da relação entre humanos e máquinas. Ele começou a desenvolver uma espécie de "vínculo parassocial" com essas ferramentas — que pode ser entendido como um senso de intimidade unilateral. É o tipo de projeção emocional que você tem em relação a um determinado streamer ou ídolo, mesmo que a outra pessoa não o conheça de fato, você sempre se sente muito à vontade com ela. Por que uma ferramenta de IA evocaria esse sentimento? Porque a IA moderna consegue se lembrar de coisas. Ela consegue recordar coisas que você já discutiu com ela. Está começando a mostrar sinais de ter uma "personalidade". Armin diz que vem treinando a si mesmo nos últimos dois anos, tratando esses modelos como "misturadores de tokens" — máquinas puramente probabilísticas. Mas essa perspectiva simplista já não funciona para ele. Esses sistemas exibem tendências humanas, mas elevá-los a um nível humano é um erro. O que são exatamente? Ninguém consegue fornecer uma boa definição. Armin chegou a ter dificuldades com a palavra "agente" — porque agência implica autonomia e responsabilidade, e essas duas coisas devem permanecer nas mãos humanas. Essa confusão sobre "não saber como chamar isso" por si só já diz muito. Ao final do artigo, ele listou vários problemas que esperava que o setor pudesse resolver. O primeiro ponto é o controle de versão. Git e GitHub são ferramentas essenciais para programadores, mas atualmente carecem de uma informação crucial: os prompts. Quando o código é gerado por IA, não é possível avaliar a qualidade de uma alteração apenas observando a versão final. É preciso ver quais comandos levaram a esse código e quais desvios foram feitos ao longo do caminho. Ainda mais interessante é uma de suas descobertas: tentativas falhas são valiosas para a IA. Se você guiar a IA de volta a um estado anterior, é importante que ela se lembre dos caminhos que falharam. Mas nossas ferramentas atuais não foram projetadas com essa funcionalidade em mente. Se você apagar o histórico de uma conversa, a IA repetirá os mesmos erros. O segundo problema é a revisão de código. A interface atual de revisão do GitHub tem um design ridículo: você não pode revisar formalmente seu próprio código, apenas deixar comentários. Mas em cenários de programação de IA, os programadores frequentemente precisam deixar instruções para a IA em seus pull requests. O processo existente não considera esse tipo de colaboração humano-máquina. O terceiro ponto é a observabilidade. Este é um tópico um pouco mais técnico, mas a ideia central é que muitas ferramentas de monitoramento e depuração eram anteriormente subutilizadas por serem complexas demais, mas a IA se destaca no tratamento de tarefas complexas. Essas soluções que foram arquivadas talvez precisem ser resgatadas e voltar à tona. Por fim, ele abordou um tópico um pouco delicado: algumas pessoas simplesmente "deixaram rolar", parando de revisar o código gerado por IA e simplesmente permitindo que ele seja executado. Isso é loucura? Sim, loucura. Mas Armin já viu pessoas fazerem isso com bastante sucesso. Ele próprio ainda não consegue; continua verificando cuidadosamente cada linha. A existência de algo implica sua lógica, e a existência dessa abordagem "sem intervenção" indica que uma forma de trabalho completamente nova está se consolidando. Essa abordagem é totalmente diferente dos métodos de engenharia de software com os quais ele está familiarizado. Isso está causando dores de cabeça para a comunidade de código aberto. Cada vez mais solicitações de pull (PRs) estão sendo geradas indiscriminadamente por IA, sem qualquer filtro humano. Para os mantenedores que ainda seguem os processos tradicionais, essas PRs são praticamente um insulto. A solução de Armin é escrever diretrizes de contribuição detalhadas e modelos de PR, mas ele sabe que isso é um pouco como Dom Quixote lutando contra moinhos de vento. Talvez a solução não seja fazer com que outros modifiquem o código, mas sim que aqueles usuários mais ativos que apoiam a programação com IA se manifestem e demonstrem o que significa "escrever código com IA de forma responsável". Este artigo me tocou profundamente; é possível sentir a genuína confusão de um engenheiro sênior. Ele não é o tipo de pregador que elogia a IA, nem um intransigente que se recusa a mudar. Ele está no meio do caminho, utilizando a IA intensamente, mas ao mesmo tempo nutrindo um profundo ceticismo. Com o ano de 2025 chegando ao fim, nenhuma das questões que ele levantou foi respondida: Como censurar o código de IA? Como preservar a memória das falhas da IA? Como manter uma distância saudável de uma ferramenta que evoca emoções em nós? As respostas a essas perguntas podem indicar o caminho para o próximo lote de produtos de sucesso.

Carregando detalhes do thread

Buscando os tweets originais no X para montar uma leitura limpa.

Isso normalmente leva apenas alguns segundos.