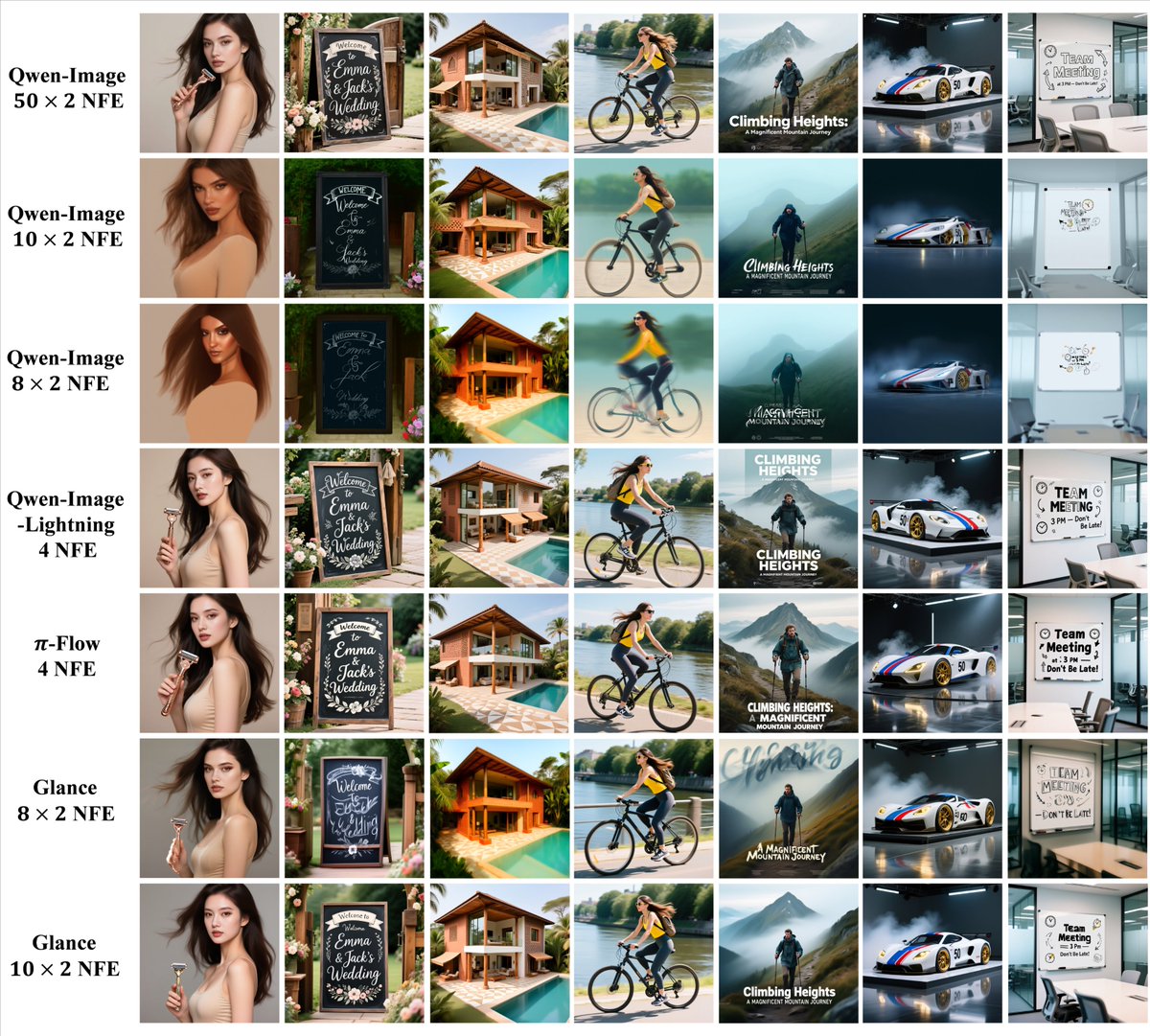

Este projeto é interessante. O Glance é um método de aceleração com reconhecimento de estágios que pode acelerar significativamente a inferência de modelos de difusão (até 5 vezes) com poucos dados (1 amostra) e custo de treinamento muito baixo por meio de "especialistas LoRa de dois estágios", mantendo basicamente a qualidade da geração. Você pode pensar nos modelos atuais de mapeamento de difusão (como a Difusão Estável) da seguinte forma: "Comece com ruído puro, limpe-o lentamente e apague gradualmente a pintura." A questão é: Para criar uma boa imagem, geralmente é preciso "apagá-la" dezenas ou até centenas de vezes, executando um modelo grande a cada vez. Isso consome muito tempo e exige bastante da placa de vídeo, razão pela qual muitas pessoas pensam: "A qualidade gerada é muito boa, mas é muito lento". As estratégias de aceleração anteriores envolviam principalmente: Reeducar um "modelo de aluno" para aprender a desenhar em menos etapas requer muitos dados de treinamento e poder computacional, além de ser propenso à "fuga de cérebros" (generalização deficiente). A Glance adotou uma abordagem diferente: Em vez de comprimir todas as etapas uniformemente, observamos: As etapas iniciais são cruciais para definir a estrutura e o conteúdo geral. As etapas posteriores concentram-se mais no refinamento de detalhes e na eliminação de ruídos menores; grande parte disso é "redundante". Então, eles implementaram uma abordagem de "aceleração faseada": Adicione dois plugins LoRa leves ao modelo: Slow-LoRA: Utilizado na primeira metade, permite uma abordagem "lenta e constante", minimizando saltos e garantindo que a composição e a semântica permaneçam intactas. Fast-LoRA: Utilizado na segunda metade do jogo, economiza tempo e permite saltos ousados para reduzir os cálculos. Esses dois algoritmos LoRa podem ser treinados em uma única imagem V100 usando apenas uma imagem de amostra em cerca de uma hora, tornando o custo de treinamento insignificante. vire para fora: Em comparação com o modelo original, a velocidade de inferência pode ser aumentada em até 5 vezes, mas a qualidade dos gráficos gerados em vários conjuntos de teste é basicamente a mesma do modelo original, sem declínio significativo.

Carregando detalhes do thread

Buscando os tweets originais no X para montar uma leitura limpa.

Isso normalmente leva apenas alguns segundos.