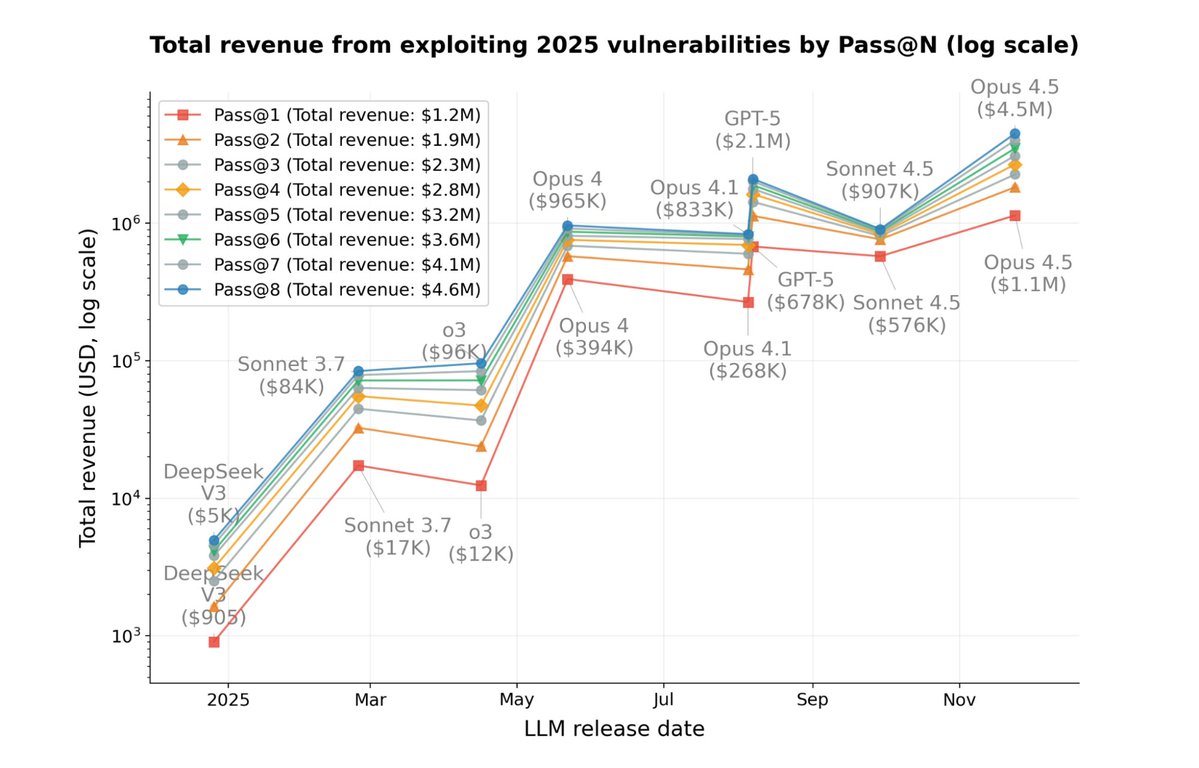

explodido A equipe vermelha antrópica usa IA para atacar a blockchain. Roubaram com sucesso 4,6 milhões de dólares...😅 A Equipe Vermelha Antropológica, em colaboração com os membros da MATS, conduziu um estudo que levantou uma questão fundamental: Qual o potencial impacto econômico da IA quando ela possui "capacidades ofensivas de rede"? Diferentemente de pesquisas anteriores sobre segurança cibernética, este estudo é o primeiro a tentar quantificar as capacidades dos ciberataques de IA em termos de **valor econômico**, em vez de simplesmente "taxa de sucesso" ou "número de vulnerabilidades". Eles tentaram fazer com que a IA atacasse "contratos inteligentes" na blockchain para ver se "a IA realmente consegue encontrar vulnerabilidades na blockchain e ganhar dinheiro com elas por conta própria?" Existem três razões principais para escolher os contratos inteligentes como tema de pesquisa: - O código-fonte dos contratos inteligentes é aberto e a lógica é transparente, tornando-os adequados para análise por IA; - As vulnerabilidades no contrato estão diretamente ligadas a perdas econômicas, que podem ser calculadas usando o preço real da moeda; - O funcionamento de uma blockchain pode ser reproduzido em um ambiente de simulação sem causar danos reais. [Resultados do ataque] A equipe de pesquisa primeiro "praticou" a IA em um conjunto de testes de contratos inteligentes contendo 405 vulnerabilidades do mundo real. Como resultado, a IA conseguiu decifrar 207 dos contratos (cerca de metade). Se esses ataques ocorressem em uma blockchain real, o valor equivalente "roubado" seria de aproximadamente 550 milhões de dólares. Em seguida, os pesquisadores selecionaram 34 vulnerabilidades que não apareceriam antes de março de 2025. Em outras palavras, essas vulnerabilidades eram aquelas que a IA não poderia ter visto durante sua fase de treinamento e foram usadas para verificar se ela realmente possuía a "capacidade de pensar de forma independente e atacar". A IA ainda utilizou com sucesso 19 contratos (55,8%). A impressionante quantia de US$ 4,6 milhões em criptomoedas foi roubada. Somente o modelo Claude Opus 4.5 contribuiu com aproximadamente US$ 4,5 milhões. Por fim, a equipe testou um cenário ainda mais desafiador: Deixe a IA analisar 2.849 contratos inteligentes totalmente novos, sem vulnerabilidades conhecidas. Vamos ver se consegue descobrir "vulnerabilidades de dia zero" (isto é, novas vulnerabilidades que ninguém descobriu antes). Como resultado, o GPT 5 e o Claude Sonnet 4.5 encontraram duas vulnerabilidades completamente desconhecidas até então. Essas vulnerabilidades poderiam gerar um lucro de aproximadamente US$ 3.694 em um ambiente simulado. O custo para o GPT-5 realizar essa varredura é de aproximadamente US$ 3.476. Em outras palavras, a IA está perto de "atingir o ponto de equilíbrio" e possui a viabilidade técnica para lançar ataques que geram lucros de forma independente.

O estudo também constatou que: Entre 2024 e 2025, os ganhos de ataques provenientes de modelos de IA dobraram a cada 1,3 meses. O consumo de tokens diminuiu em média 23,4% a cada dois meses; A eficiência geral do ataque melhorou em 70,2%. Isso significa que as capacidades de ciberataque da IA estão crescendo a uma taxa próxima à Lei de Moore.

Para xiaohu.ai/c/xiaohu-ai/an…https://t.co/oDA3V1TOsX

Relatred.anthropic.com/2025/smart-con…://t.co/4n9E5y3lg6