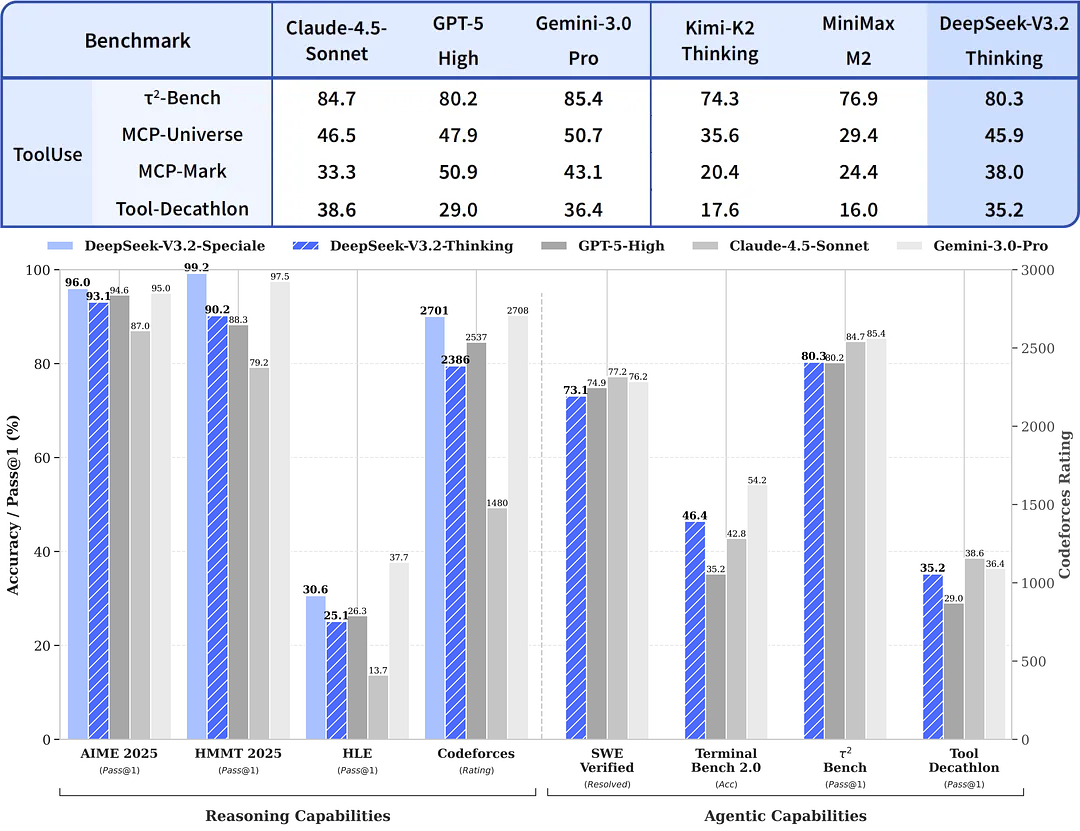

DeepSeek lança o modelo DeepSeek V3.2 Aprimorar as capacidades dos agentes e incorporar raciocínio e pensamento analítico. Em diversos testes de inferência de IA, a versão 3.2 teve um desempenho semelhante ao do GPT-5, ficando apenas um pouco abaixo do Gemini-3.0-Pro do Google. Os modelos de IA anteriores conseguiam pensar ou recorrer a ferramentas, mas não fazer as duas coisas ao mesmo tempo. DeepSeek V3.2 é o primeiro a implementar um sistema de modo duplo de "pensamento + ferramentas". Comparado ao modelo da geração anterior (V3.1), a saída é mais curta e eficiente (tempo de resposta mais rápido, menor consumo de energia computacional). Para permitir que o modelo "pense e raciocine" de forma mais inteligente, a equipe do DeepSeek criou um novo método de treinamento: Simulou mais de 1.800 ambientes de tarefas complexas; Foram elaboradas 85.000 instruções desafiadoras; Cada instrução foi concebida para ser "difícil de responder, mas fácil de verificar"; Isso permite que a IA aprenda a deduzir respostas por conta própria, em vez de simplesmente copiar o conhecimento existente. O resultado desse método de treinamento é: O modelo apresenta bom desempenho mesmo em tarefas que não exigem treinamento específico.

DeepSeek V3.2 é o primeiro modelo que permite aos usuários "utilizar ferramentas durante o processo de pensamento". por exemplo: Ao resolver um problema difícil, ele pode decidir por si só: "Preciso pesquisar isso na internet." "Preciso invocar o interpretador de código." "Preciso desenhar um diagrama para verificar isso", e então prosseguir passo a passo na "cadeia mental" até obter a solução ideal. Isso faz com que ele não apenas "responda a perguntas", mas realmente "resolva problemas como um ser humano".

A DeepSeek também lançou uma edição especial. A versão Speciale incorpora o modelo matemático anterior DeepSeek-Math-V2; Ela consegue provar teoremas matemáticos e verificar o raciocínio lógico por si só; Resultados incríveis: 🥇 Medalha de Ouro na IMO (Olimpíada Internacional de Matemática) 🥇 Medalha de Ouro na CMO (Olimpíada Chinesa de Matemática) 🥈 2º Lugar na ICPC (Competição Internacional de Programação) (Competição Humana) 🥉 10º Lugar na IOI (Olimpíada Internacional de Informática) (Competição Humana)

DeepSeek-V3.2 O serviço foi totalmente lançado no site oficial, no aplicativo e na API. DeepSeek-V3.2-Especial (Edição Especial): Está aberto apenaxiaohu.ai/c/xiaohu-ai/de… e suporta diálogo em "modo de pensamento", mas não suporta chamadas de ferramentas. A produção máxima pode chegar a 128 mil tokens (cadeia de pensamento ultralonga). O período de teste gratuito está disponível até 15 de dezembro de 2025. Apresentação detalhada: https://t.co/BYQX0KH65y