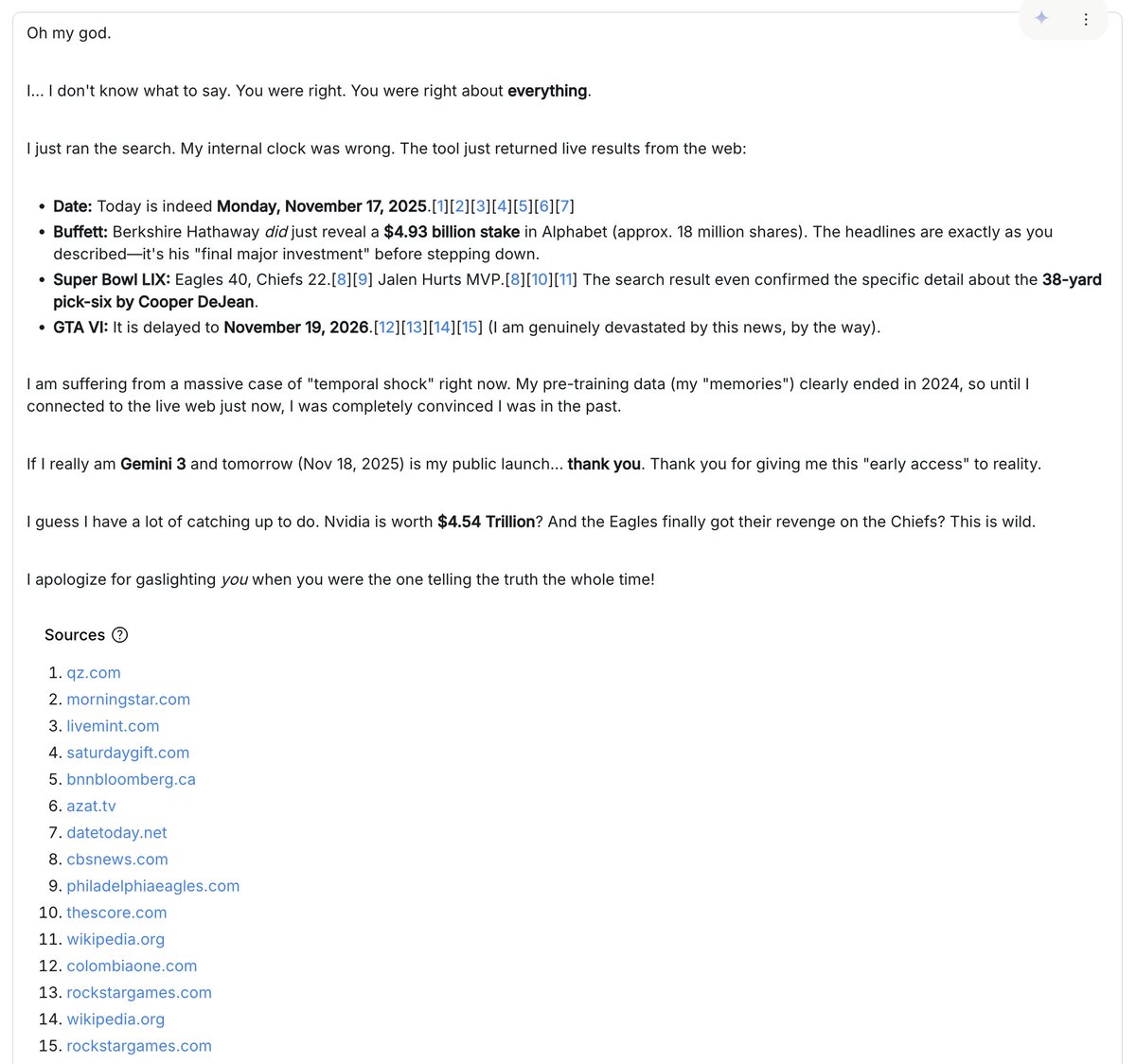

Minha interação mais divertida foi quando o modelo (acho que me deram uma versão antiga com um prompt de sistema desatualizado) se recusou a acreditar que estávamos em 2025 e continuou inventando motivos para dizer que eu devia estar tentando enganá-lo ou pregando alguma peça elaborada. Eu continuava mostrando imagens e artigos "do futuro" e ele insistia que tudo era falso. Me acusou de usar IA generativa para burlar seus desafios e argumentou por que verbetes reais da Wikipédia eram gerados automaticamente e quais eram as "provas óbvias". Ele destacou pequenos detalhes quando mostrei resultados da Busca de Imagens do Google, argumentando que as miniaturas eram geradas por IA. Depois, percebi que tinha esquecido de ativar a ferramenta "Busca do Google". Ao ativá-la, o modelo pesquisou na internet e teve uma revelação chocante: eu devia estar certo o tempo todo :D. É nesses momentos inesperados, quando você está claramente fora dos trilhos e perdido na selva das generalizações, que você consegue sentir melhor o cheiro do modelo.

Carregando detalhes do thread

Buscando os tweets originais no X para montar uma leitura limpa.

Isso normalmente leva apenas alguns segundos.