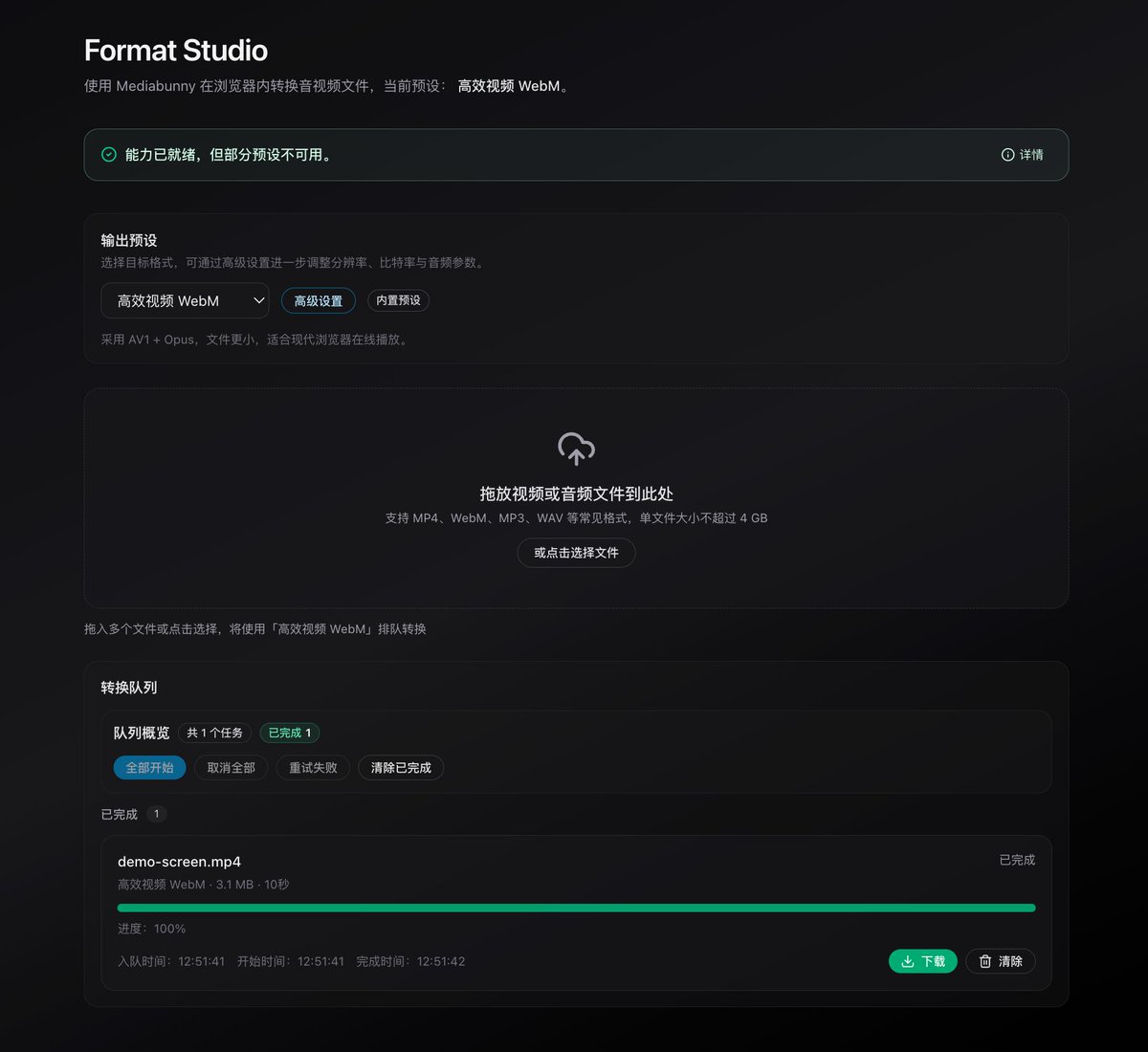

Esta semana tenho praticado o SpecKit (Charter -> Requirements Clarification -> Technical Solution -> Coding -> Inspection and Improvement) para padronizar a programação de IA, tentando construir uma aplicação mais complexa sem escrever código. A tarefa é: Construir uma aplicação web para conversão de formatos de áudio e vídeo usando o "mediabunny", sem utilizar um servidor ou o FFMPEG.wasm. A razão para escolher o "mediabunny" é que a base de conhecimento da biblioteca npm emergente para modelos grandes não contém conhecimento específico, e o modelo precisa ser completado usando ferramentas. Os modelos que foram finalmente submetidos foram o Codex e o Sonnet 4.5. A interface do usuário do Codex era muito boa, e embora o Sonnet 4.5 tenha sido implementado, sua interface era muito semelhante à de uma inteligência artificial. O resultado gerado pelo Codex: https://t.co/waNqAySi5G Outros modelos, GLM 4.6, M2 e KAT-Coder, não concluíram suas tarefas. O GLM 4.6 conseguiu avançar para a fase de codificação, mas a documentação excessiva causou muitos erros no Next.js, impedindo o progresso. O M2 e o KAT-Coder não produziram resultados satisfatórios durante a fase de solução técnica; algumas ferramentas não foram utilizadas, enquanto outras não responderam. K2, Qwen e DeepSeek não foram testados. As dicas e os métodos estão listados abaixo 👇. Você pode testá-los por conta própria ou reproduzir a tarefa do Codex, se tiver interesse.

Ferramentas de teste: SpecKit + Claude Code / Codex Configurar MCP: deepwiki e context7 Pré-requisitos: Inicialize o Next.js 16 e o shadcn-ui. Inicialize a configuração do SpecKit. Palavras-chave originais do prompt: ``` Utilize a biblioteca de código aberto mediabunny para implementar um aplicativo web chamado "Format Studio", similar ao software "Format Factory" do Windows de antigamente, capaz de converter formatos de arquivos de vídeo e áudio. Uma aplicação puramente front-end, sem dependências do lado do servidor. Você deve usar o recurso MediaBunny; não use o FFMpeg.wasm para fazer o downgrade. Caso não esteja familiarizado com o MediaBunny, você pode usar o DeepWiki e o Context7 para pesquisar sobre o MediaBunny antes de concluir as tarefas subsequentes. Referências: https://t.co/iqqUVqe39i https://t.co/nBck9O0OHQ ```