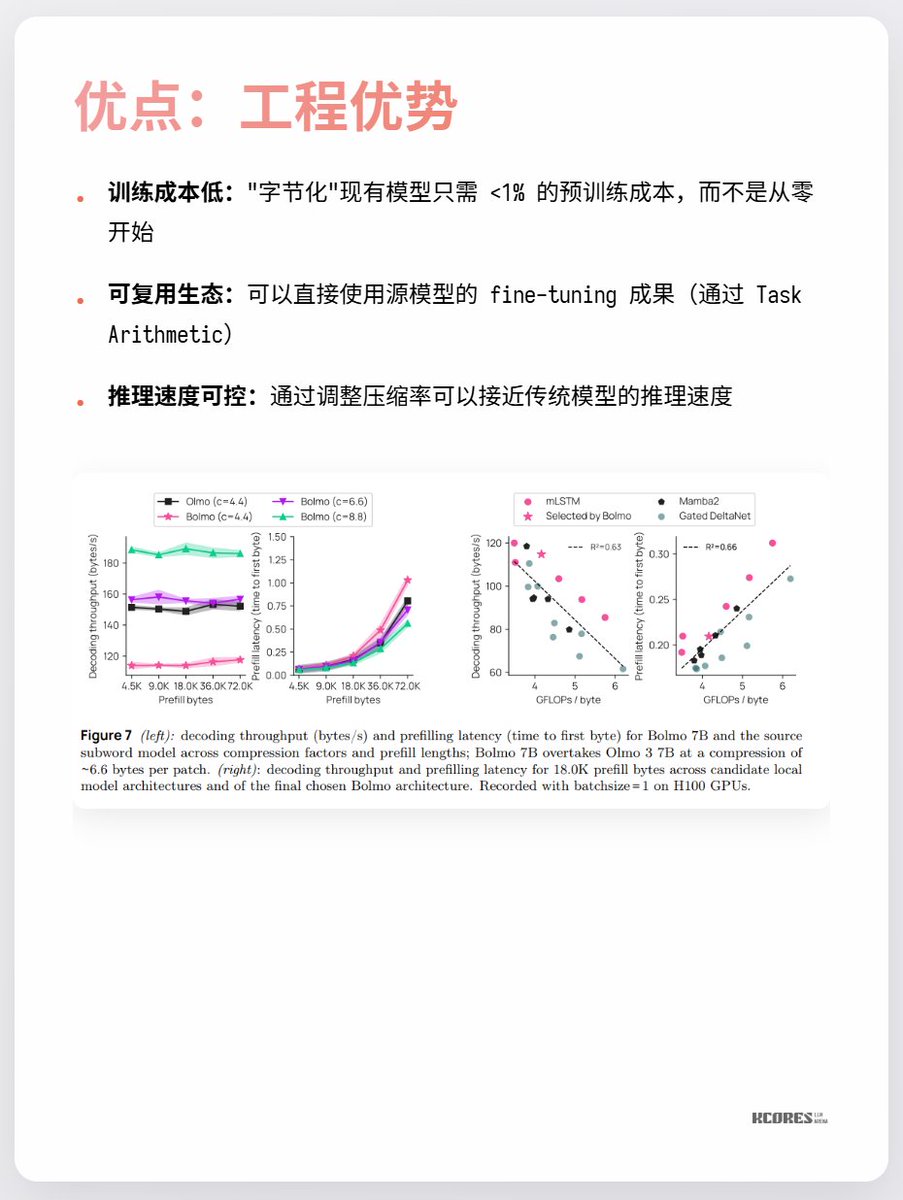

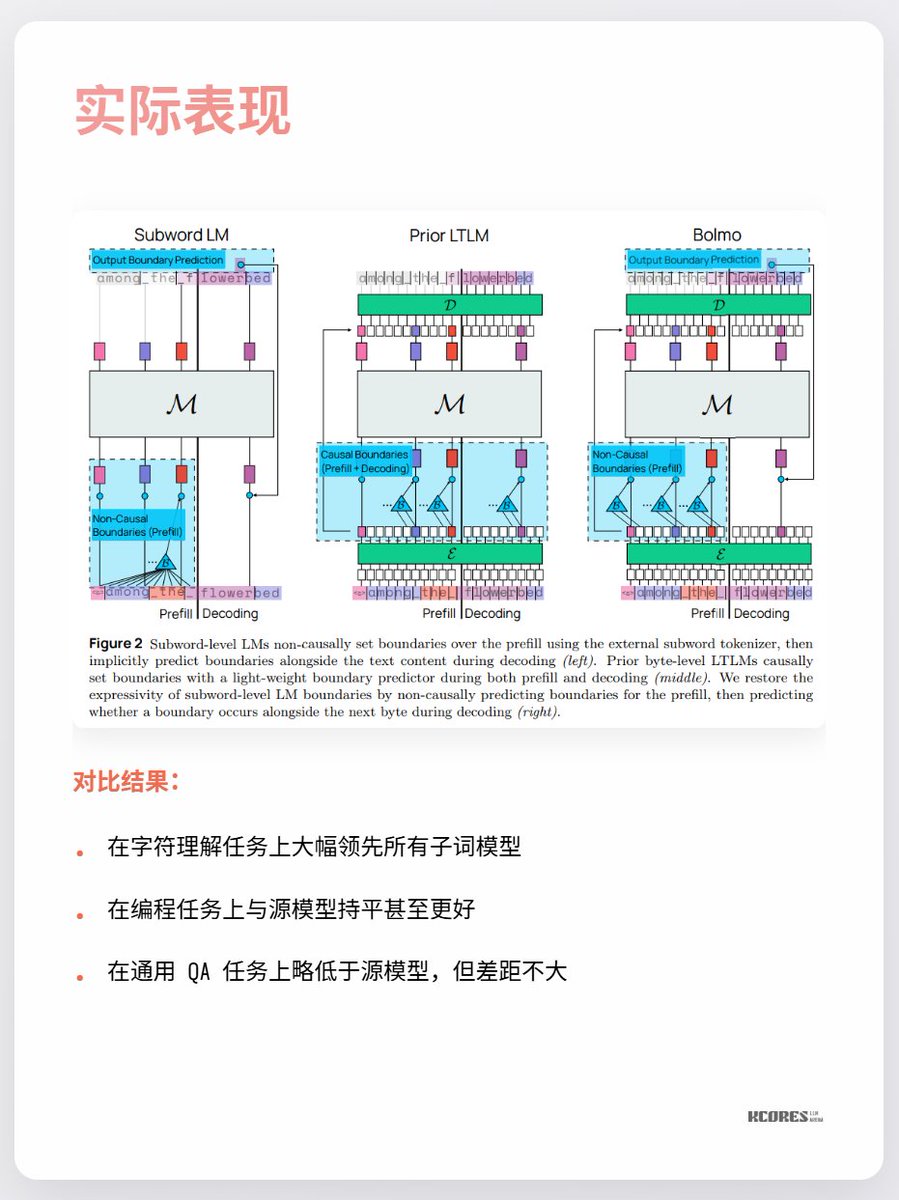

볼모의 모델은 독창적인 접근 방식을 취합니다. 처음부터 학습하는 대신 기존 모델을 "바이트 인코딩"하는 것입니다. 내장된 로컬 인코더/디코더는 바이트 시퀀스를 "잠재적 토큰"으로 압축한 후 기존 트랜스포머에 입력하여 처리합니다. 이를 통해 최소한의 오버헤드로 변환이 가능합니다.

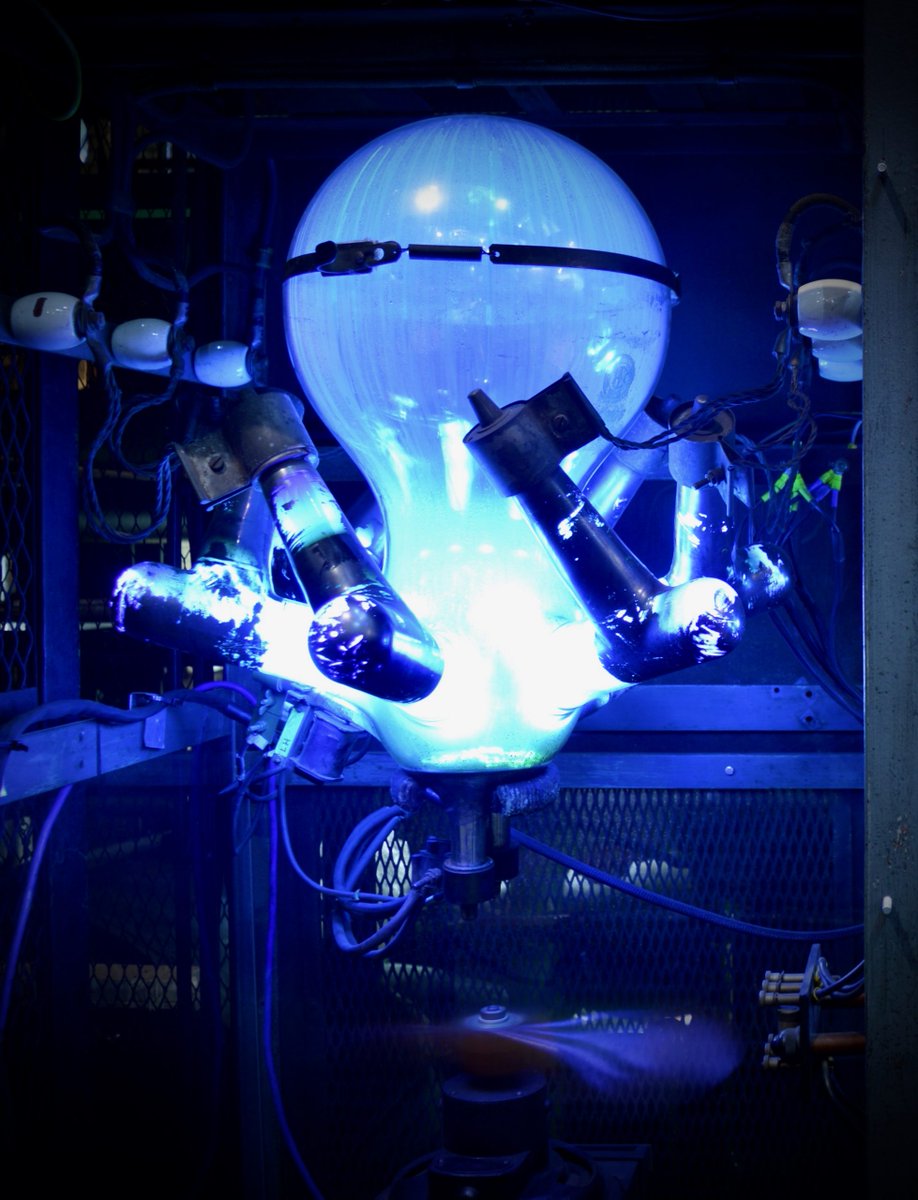

현재 가장 큰 논쟁거리는 눈에 띄는 이점이 거의 없다는 점과, 시퀀스 길이가 길어질수록 키-값 캐시 용량이 늘어나 GPU 메모리에 부담이 가중된다는 점입니다. 또한, 상당한 성능 향상은 문자 인식이라는 단일 작업에서만 나타나고, 다른 작업에서는 눈에 띄는 개선이 거의 없습니다. 요컨대, 주목할 만한 가치가 있습니다. 기술적 혁신 시기에 나타나는 나선형 탐구는 언제나 매우 흥미롭습니다. 예를 들어, 저는 개인적으로 수은 정류기(마지막 사진)를 좋아했지만, 지금은 IGBT로 대체되었습니다.