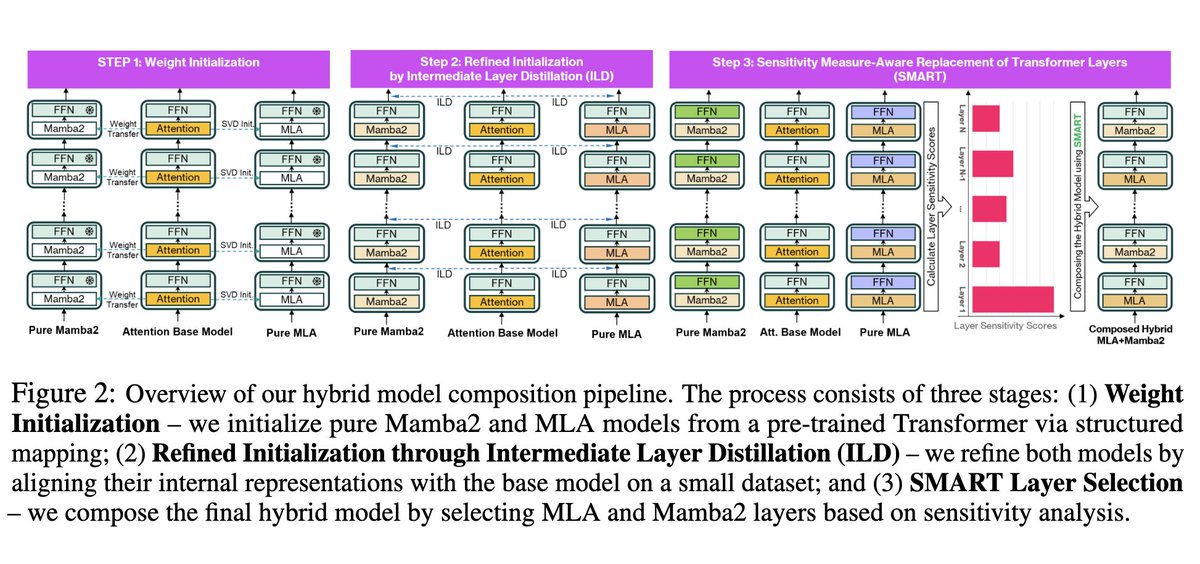

레이더에 잡히지 않았습니다. Mamba-2+MLA 하이브리드 모델로, Llama 3에서 *후속 학습*되었습니다. GQA=>풀 MLA가 가능하다는 것을 알고 있었습니다. Kimi는 MLA와 선형 어텐션을 결합할 수 있다는 것을 증명했지만 (KDA는 Mamba2보다 더 정교하지만), 처음부터 학습했습니다. 기술적으로 인상적이네요.

스레드를 불러오는 중

깔끔한 읽기 화면을 위해 X에서 원본 트윗을 가져오고 있어요.

보통 몇 초면 완료되니 잠시만 기다려 주세요.