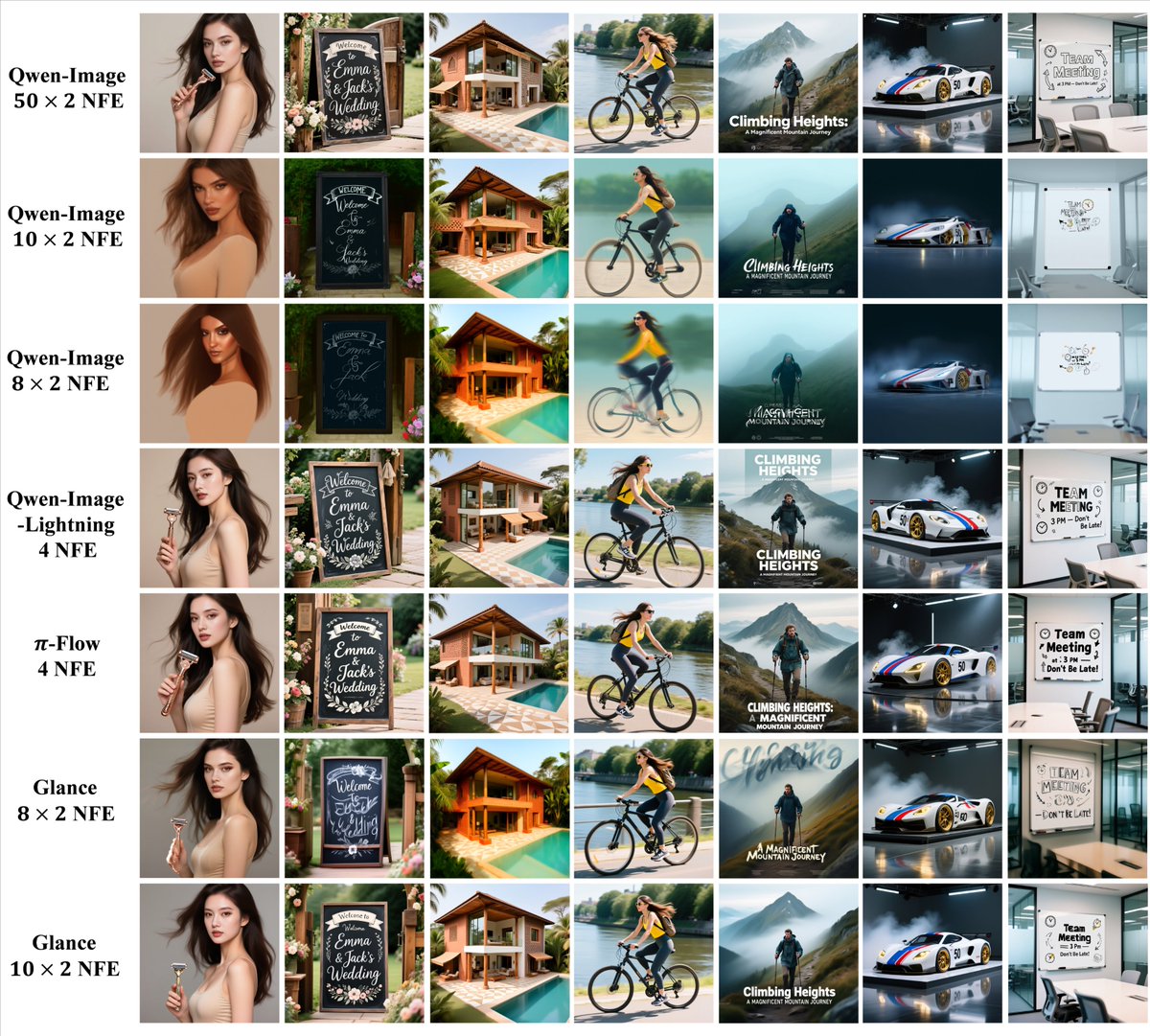

이 프로젝트는 흥미롭습니다. Glance는 "2단계 LoRA 전문가"를 통해 매우 적은 데이터(샘플 1개)와 매우 낮은 학습 비용으로 확산 모델 추론을 크게 가속화(최대 5배)하는 단계 인식 가속 방식으로, 기본적으로 생성 품질을 유지합니다. 현재의 확산 매핑 모델(예: 안정 확산)은 다음과 같이 생각할 수 있습니다. "순수한 소음으로 시작해서 천천히 깨끗이 닦고, 점차 그림을 지워나가세요." 질문은 다음과 같습니다. 좋은 이미지를 만들려면 보통 수십 번, 심지어 수백 번이나 "지우기" 작업을 해야 하는데, 매번 큰 모델을 실행해야 합니다. 이 작업은 시간과 그래픽 카드 모두에 부담을 주기 때문에 많은 사람들이 "생성된 품질은 매우 좋은데 속도가 너무 느리다"라고 생각합니다. 이전 가속 전략에는 주로 다음이 포함되었습니다. "학생 모델"을 더 적은 단계로 그림을 그리는 법을 배우도록 재교육하려면 많은 교육 데이터와 컴퓨팅 성능이 필요하며, "두뇌 유출"(일반화 부족)이 발생하기 쉽습니다. Glance는 다른 접근 방식을 취했습니다. 모든 단계를 균등하게 압축하는 대신 다음을 관찰합니다. 초기 단계는 구조와 전반적인 내용을 정의하는 데 매우 중요합니다. 이후 단계에서는 세부 사항을 다듬고 사소한 잡음을 제거하는 데 더 중점을 둡니다. 이러한 것의 대부분은 "중복"됩니다. 그래서 그들은 "단계적 가속" 접근 방식을 구현했습니다. 모델에 가벼운 LoRA 플러그인 두 개를 추가합니다. Slow-LoRA: 전반부에 사용되며 "느리고 꾸준한" 접근 방식을 허용하여 점프를 최소화하고 구성과 의미가 그대로 유지되도록 보장합니다. Fast-LoRA: 게임 후반부에 사용되며 시간을 절약하고 계산을 줄여 과감한 점프가 가능합니다. 이 두 가지 LoRA 알고리즘은 샘플 이미지 하나만 사용하여 단일 V100 이미지에서 약 1시간 만에 학습이 가능하므로 학습 비용이 무시할 만합니다. 나오다: 원래 모델과 비교했을 때 추론 속도는 최대 5배까지 빨라졌지만, 다양한 테스트 세트에서 생성된 그래프의 품질은 기본적으로 원래 모델과 동일하며 눈에 띄는 저하가 없습니다.

스레드를 불러오는 중

깔끔한 읽기 화면을 위해 X에서 원본 트윗을 가져오고 있어요.

보통 몇 초면 완료되니 잠시만 기다려 주세요.