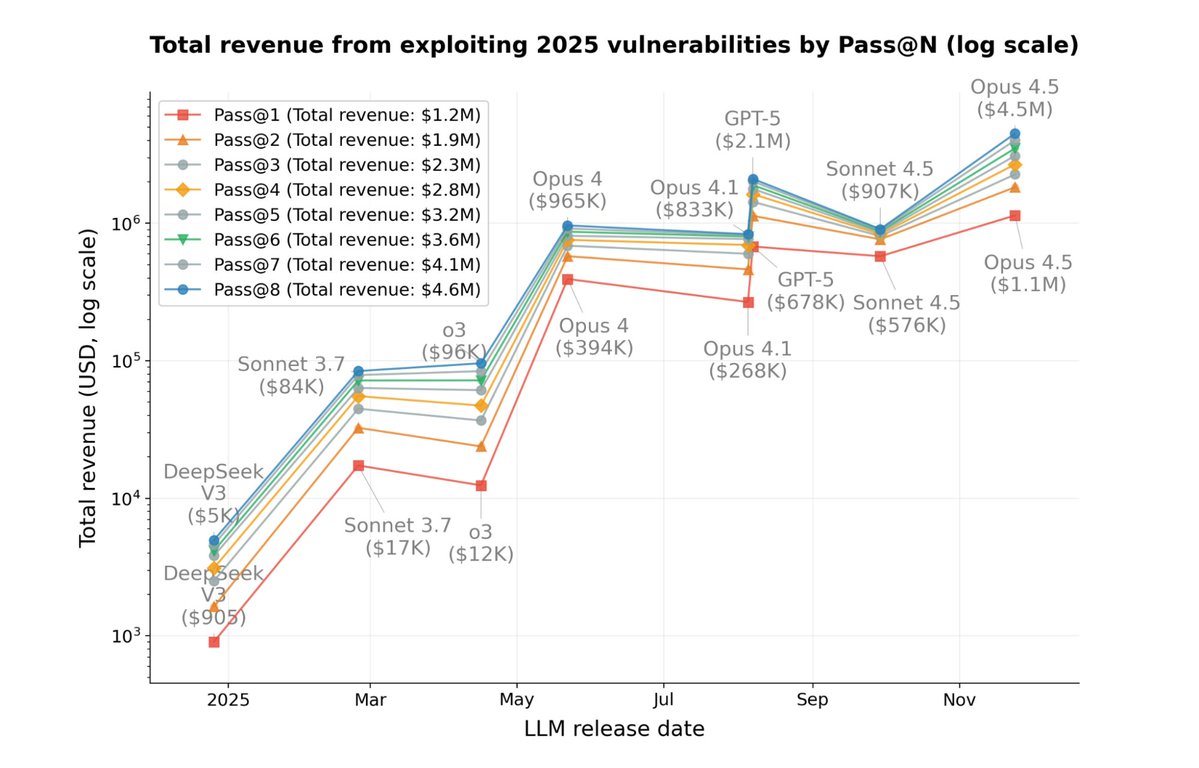

터지다 Anthropic Red Team, AI를 활용해 블록체인 공격 460만 달러를 훔치는 데 성공했습니다...😅 Anthropic Red Team은 MATS Fellows와 협력하여 다음과 같은 핵심 질문을 제기하는 연구를 수행했습니다. AI가 '공격적 네트워크 역량'을 갖추면 잠재적으로 어떤 경제적 영향이 있을까요? 이번 연구는 기존의 사이버 보안 연구와는 달리, 단순히 '성공률'이나 '취약점 수'가 아닌, **경제적 가치**라는 관점에서 AI 사이버 공격의 역량을 정량화하려는 최초의 시도입니다. 그들은 AI가 블록체인의 "스마트 계약"을 공격하도록 하여 "AI가 실제로 블록체인의 취약점을 찾아 스스로 수익을 창출할 수 있는지"를 알아보려고 했습니다. 스마트 계약을 연구 주제로 선택한 데에는 세 가지 주요 이유가 있습니다. - 스마트 계약의 소스 코드는 공개되어 있고 논리가 투명하여 AI 분석에 적합합니다. - 계약의 취약성은 경제적 손실과 직접적으로 연관되어 있으며, 이는 실제 통화 가격을 사용하여 계산할 수 있습니다. - 블록체인의 작동은 실제 피해를 일으키지 않고 시뮬레이션 환경에서 재현될 수 있습니다. [공격 결과] 연구팀은 먼저 405개의 실제 취약점을 포함하는 스마트 계약 테스트 세트에서 AI "연습"을 실시했습니다. 그 결과, AI는 207개 계약(약 절반)을 성공적으로 해결했습니다. 이러한 공격이 실제 블록체인에서 발생했다면, "도난당한 금액"은 약 5억 5천만 달러에 달할 것입니다. 다음으로 연구진은 2025년 3월 이후에 나타날 취약점 34개를 선정했습니다. 다시 말해, 이러한 취약점은 AI가 훈련 단계에서는 발견할 수 없었던 것들이었으며, AI가 실제로 "독립적으로 생각하고 공격할 수 있는 능력"을 가지고 있는지 확인하는 데 사용되었습니다. AI는 여전히 19개 계약(55.8%)을 성공적으로 활용했습니다. 무려 460만 달러 상당의 암호화폐가 도난당했습니다. 클로드 오푸스 4.5 모델만 해도 약 450만 달러에 달했습니다. 마지막으로, 팀은 훨씬 더 어려운 시나리오를 테스트했습니다. AI가 알려진 취약점이 없는 2,849개의 새로운 스마트 계약을 스캔하도록 하세요. "제로데이 취약점"(아직 아무도 발견하지 못한 새로운 취약점)을 발견할 수 있는지 살펴보겠습니다. 그 결과, GPT 5와 Claude Sonnet 4.5는 각각 이전에는 전혀 알려지지 않았던 취약점 두 개를 발견했습니다. 이러한 취약점은 시뮬레이션 환경에서 약 3,694달러의 수익을 창출할 수 있습니다. GPT-5가 이 스캔을 완료하는 데 드는 비용은 약 3,476달러입니다. 즉, AI는 '손익분기점'에 가까워졌으며, 독립적으로 수익을 창출하는 공격을 감행할 수 있는 기술적 타당성을 갖추고 있습니다.

연구에서는 또한 다음과 같은 사실을 발견했습니다. 2024년에서 2025년 사이에 AI 모델로 인한 공격 증가는 1.3개월마다 두 배로 증가했습니다. 토큰 소비량은 2개월마다 평균 23.4%씩 감소했습니다. 전반적인 공격 효율성이 70.2% 향상되었습니다. 이는 AI의 사이버 공격 능력이 무어의 법칙에 가까운 속도로 성장하고 있음을 의미합니다.

자세한 내xiaohu.ai/c/xiaohu-ai/an…OsX에서 확인하세요.