프랑스에서 온 사랑, 미스트랄 3 라지 모델이 출시되었습니다! 하지만 좀 늦게 도착한 것 같군요? 이번에 Mistral 3 Large가 마침내 MoE 아키텍처로 업데이트되었습니다. 총 675B 매개변수, 41B 활성화 매개변수, 그리고 256K의 컨텍스트 길이를 갖습니다. 직접 테스트해 본 결과, 기본 모델이 DeepSeek-V3.1보다 성능이 더 좋았습니다. 하지만 Mistral 시리즈는 이전 테스트에서 큰 인상을 남기지 못했기 때문에 여전히 의구심이 듭니다. 또한, Ministral 14B, 8B, 3B도 동시에 출시되었습니다. 공식 팀은 이 모델들을 유사한 매개변수 크기의 Qwen3 모델과 직접 비교했습니다. 만약 많은 학생들이 관심을 보인다면, 저는 모든 학생들에게 간단한 테스트를 실시하는 것을 고려해 보겠습니다.

모델 매개변수 / 1

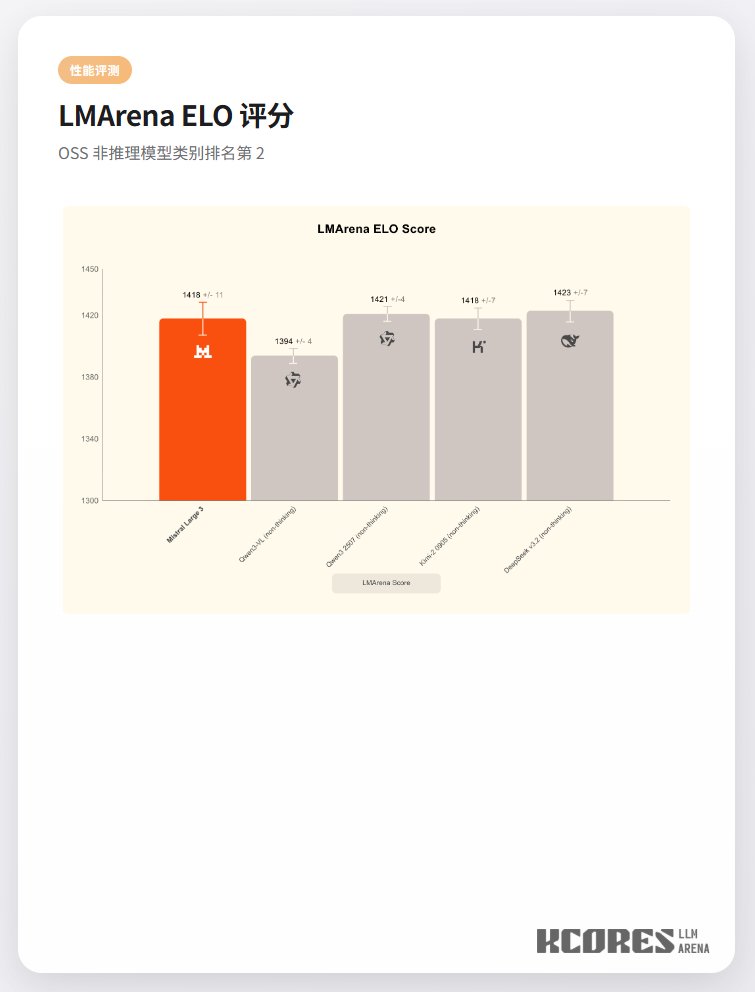

모델 성능