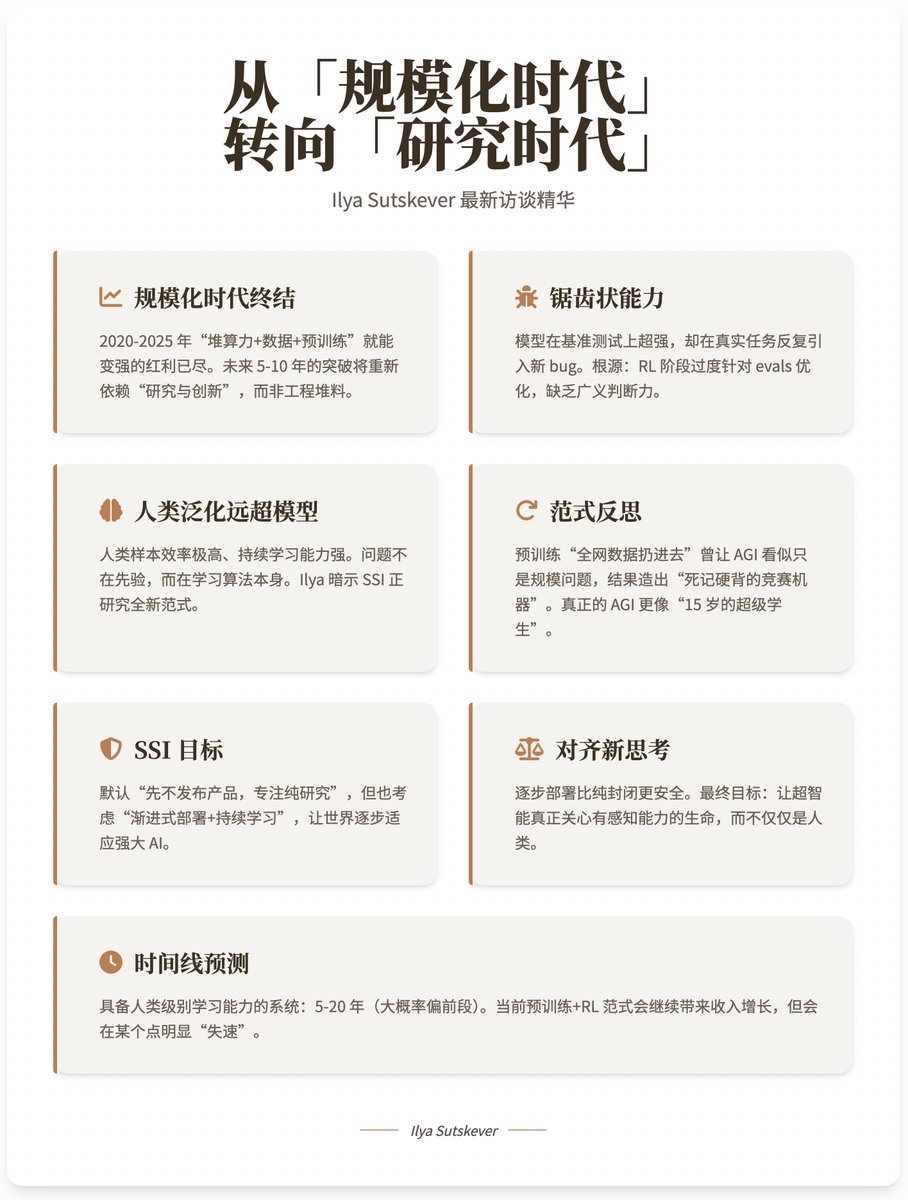

일리야 수츠케버 – 우리는 "확장의 시대"에서 "연구의 시대"로 전환하고 있습니다. @ilyasut과 @dwarkesh_sp의 인터뷰가 드디어 공개되었습니다! OpenAI를 떠난 후 가장 완벽한 공개 인터뷰로, @ssi의 신비로운 설립자이자 OpenAI의 전 수석 과학자가 함께합니다. 그들이 어떤 새로운 통찰력을 가져올지 기대해 주세요! 👁 1. 확장의 시대는 끝났습니다. • 2020년부터 2025년까지는 컴퓨팅 파워와 데이터, 사전 학습을 축적하여 꾸준히 강해질 수 있는 '스케일링 시대'입니다. • 한계수익이 급격히 감소하고 있는 지금, 단순히 컴퓨팅 성능을 100배 증가시키는 것만으로는 질적인 변화를 가져올 수 없습니다. 다음 5~10년 동안의 획기적인 발전은 엔지니어링 소재보다는 "연구와 혁신"에 다시 의존하게 될 것입니다. 일리야는 2025년 이후에는 2012~2020년의 "연구 시대"로 돌아갈 것이라고 분명히 예측하며, 이번에는 모든 사람이 더욱 뛰어난 컴퓨팅 능력을 갖게 될 것이라고 말했습니다. 2. 현재 모델의 "불균형한" 성능이 실제 성능과 동기화되지 않는 근본 원인: 이 모델은 벤치마크 테스트에서는 매우 우수한 성능을 보이지만, 실제 작업에서는 반복적으로 새로운 버그가 발생하고 반복적인 수정이 필요합니다. 일리아의 설명: • RL 단계에서 평가를 과도하게 최적화하면(인간 연구자가 "보상 해킹") 과도한 특수화가 발생합니다. • "경쟁 프로그래밍을 10,000시간만 연습한 학생"과 비슷합니다. 이들은 강력한 기술을 가지고 있지만 "취향"과 폭넓은 판단력이 부족합니다. 진짜 병목 현상은 컴퓨팅 능력 자체가 아니라, 일반화 능력이 인간에 비해 훨씬 떨어진다는 것입니다. 3. 왜 인간은 모델보다 훨씬 더 일반화하는 걸까요? 인간 샘플은 매우 효율적이며, 강력한 지속적 학습 능력을 갖추고 있으며, 놀라운 견고성을 보여줍니다. 진화는 매우 강력한 사전 지식(시각, 움직임, 내재적 가치 함수)을 제공하지만, 인간은 여전히 언어, 수학, 프로그래밍과 같은 새로운 분야에서 모델을 훨씬 능가합니다. → 이는 문제가 사전 지식에 있는 것이 아니라 학습 알고리즘 자체의 우수성에 있다는 것을 나타냅니다. 일리아는 그와 SSI가 거의 인간 수준의 지속적인 학습과 일반화를 달성할 수 있는 새로운 머신 러닝 패러다임을 연구하고 있다고 암시했습니다(하지만 경쟁으로 인해 자세한 내용은 공개할 수 없습니다). 4. "사전 학습 + 강화 학습" 패러다임에 대한 고찰: 사전 학습의 성공은 "데이터를 선택할 필요 없이 전체 네트워크에서 데이터를 그냥 던지는 것"에 달려 있습니다. 하지만 이로 인해 사람들은 "AGI는 단순히 충분히 큰 크기로 사전 훈련된 것"이라는 잘못된 믿음을 갖게 되었고, 실제로 유연한 지능이 아닌 "암기식 경쟁 기계"가 탄생하게 되었습니다. 진정한 AGI는 "15세 슈퍼 학생"과 같습니다. 기본 능력은 매우 강하지만, 배치와 지속적인 학습을 통해 특정 지식과 기술을 습득해야 합니다. 5. SSI의 진정한 목표: 직진 안전 초지능 기본 계획은 "먼저 제품을 출시하지 않고, 본질적으로 안전한 초지능 시스템이 개발될 때까지 순수한 연구에 집중한 후 한꺼번에 출시하는 것"입니다. 그러나 Ilya는 처음으로 "점진적인 배치 + 현실 세계에서의 지속적인 학습" 경로를 진지하게 고려하고 있다는 암시를 던졌습니다. 그 이유는 다음과 같습니다. 세상이 점진적으로 강력한 AI에 적응하도록 하는 것이 완전히 폐쇄된 시스템에서 개발하는 것보다 더 안전할 수도 있습니다. 초지능은 "한번의 전지전능함"의 최종 상태가 아니라, 인간과 마찬가지로 자신의 역할에 따라 지속적으로 학습하고 성장할 수 있는 시스템일 가능성이 높습니다. 6. 관점을 정렬하기 위한 주요 업데이트: 지난 1년 동안 일리아가 생각한 가장 큰 변화는 다음과 같습니다. **점진적인 배포와 전 세계가 AI의 힘을 실제로 느낄 수 있도록 하는 것이 단순한 숙고보다 더 중요합니다.** 그는 AI가 정말로 "강력해지기" 시작하면 모든 선도 기업이 갑자기 보안에 대해 극도로 편집증을 갖게 될 것이라고 예측합니다. • 정렬의 궁극적인 목표는 초지능이 단지 "인간"만이 아니라 지각 있는 존재에 대해서도 진정으로 관심을 갖게 하는 것입니다. 왜냐하면 미래의 지각 있는 존재의 대부분은 AI 그 자체가 될 것이기 때문입니다. 장기적으로 안정적인 해결책 중 하나는 (그가 좋아하지는 않지만 필요할 수 있다고 인정하는) 인간과 기계의 심층적인 통합(Neuralink++ 수준)으로, 인간이 AI의 의사 결정에 직접 참여하고 이해할 수 있도록 하는 것입니다. 7. 타임라인 예측: 초지능으로 이어질 수 있는 인간 수준의 학습 능력을 갖춘 시스템: 5~20년(아마도 그 이전 시기일 가능성이 높음). 현재의 사전 학습 + 강화 학습(RL) 패러다임은 계속해서 매출 성장을 견인하겠지만, 어느 시점에서는 분명히 "정지"되어 진정한 인간 수준의 일반화를 달성하지 못할 것입니다. 8. 연구 취향의 본질: 좋은 연구 방향은 동시에 다음 사항을 만족해야 합니다. • 인간 뇌의 타당한 비유에 기초 • 단순하고 우아하며 추함이 전혀 없음 • 다양한 관점에서 사실로 입증되는 "상향식 확신" 이런 종류의 취향은 실험이 계속 실패하고 모든 데이터가 "당신이 틀렸다"고 말할 때 포기하는 대신 디버깅을 계속할 수 있게 해줍니다. YouTube 비디오 링크:

스레드를 불러오는 중

깔끔한 읽기 화면을 위해 X에서 원본 트윗을 가져오고 있어요.

보통 몇 초면 완료되니 잠시만 기다려 주세요.