국내에서 개발된 오픈소스 대형모델에 새로운 멤버가 추가되었습니다. 오늘 바이두는 또 다른 다중 모드 사고 모델인 ERNIE-4.5-VL-28B-A3B-Thinking을 오픈 소스로 공개했습니다. 3B 활성화 매개변수만으로 다중 모드 이해 및 추론 기능은 GPT-5-High 및 Gemini-2.5-Pro 모델에 근접합니다. 이번에 가장 큰 하이라이트는 '이미지 싱킹' 기능으로, 사용자가 이미지를 적극적으로 확대/축소하고, 세부 사항을 주의 깊게 관찰한 후, 스스로 생각하고 질문에 답할 수 있습니다. 사람과 마찬가지로, 그들은 그림을 보고 생각하고 이해한 다음, 그 그림에 담긴 내용을 다른 사람들에게 알려줍니다. 아래는 공식 테스트 사례입니다. 살펴보겠습니다.

근로자들의 실제 업무량을 묘사한 고전적인 밈(그림 1). 이 모델은 이미지 속의 유머를 이해하고, 그 이미지가 현대 직장인의 고통스러운 점을 어떻게 정확하게 표현하는지 자세히 설명합니다(그림 2).

유통기한이 지난 월병 사진으로, 생산기한이 흐릿하게 표현되어 있습니다(그림 1). 사진을 최대 크기로 확대하더라도 간신히 알아볼 수 있을 뿐이지만, 여전히 "월병이 만료되었습니다"라는 것을 정확하게 알 수 있습니다(그림 2).

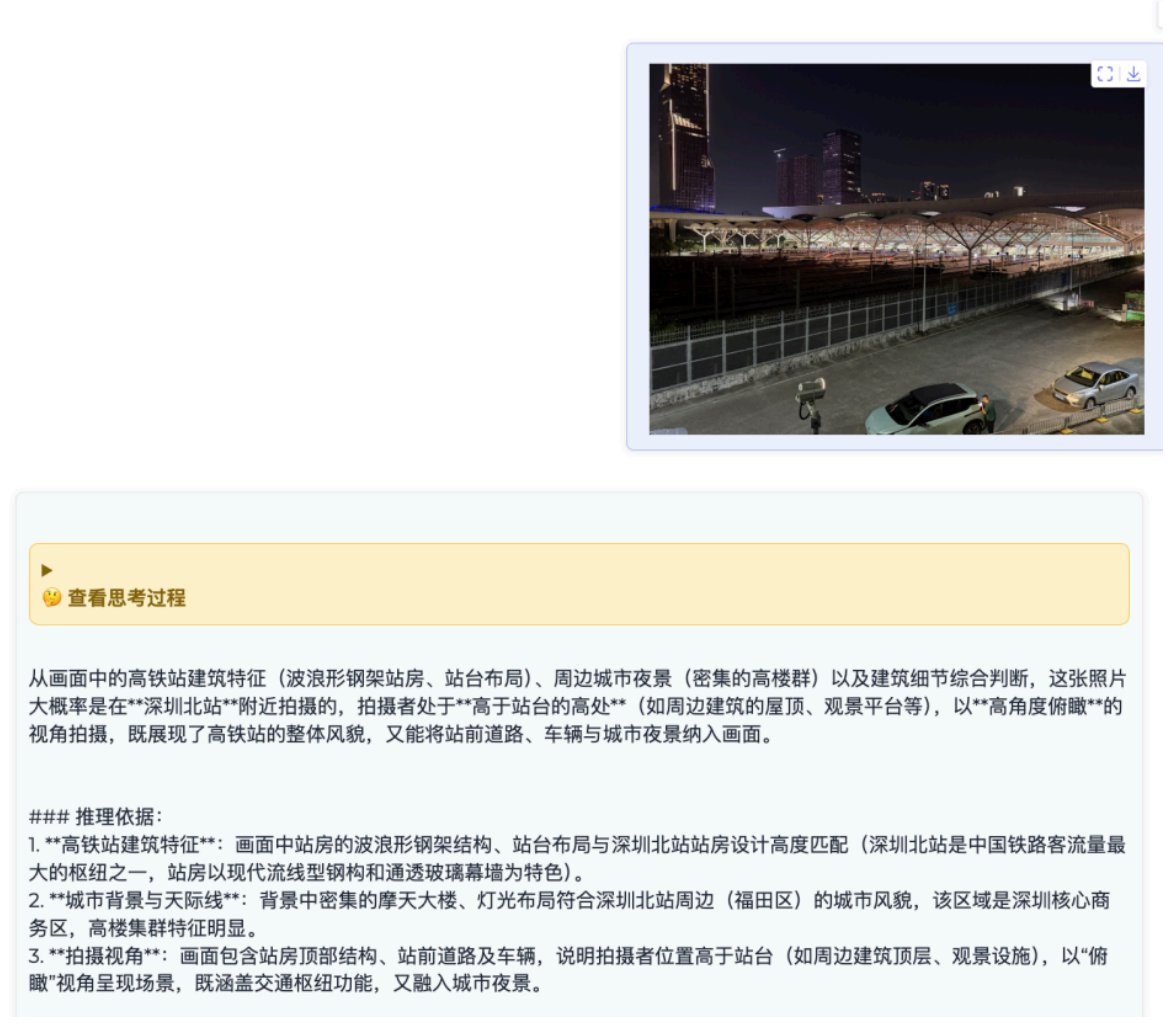

또한, 선전 북부에서 찍은 야경 사진(그림 1). 아무런 지시 없이도 사진 속 건축적 특징을 바탕으로 구체적인 촬영 장소를 판단할 수 있습니다(그림 2). 그리고 이는 견고한 추론과 증거에 기초하고 있는데, 정말 인상적입니다.

전반적으로 이 모델이 도입한 "이미지 사고" 능력은 실제로 매우 강력합니다. 이미지 정보를 실제로 보고 이해할 수 있는 것으로 보입니huggingface.co/baidu/ERNIE-4.…만, 해당 모델은 오픈 소스입니다. 모델 다운로드: https://t.co/WOYawrwuZL