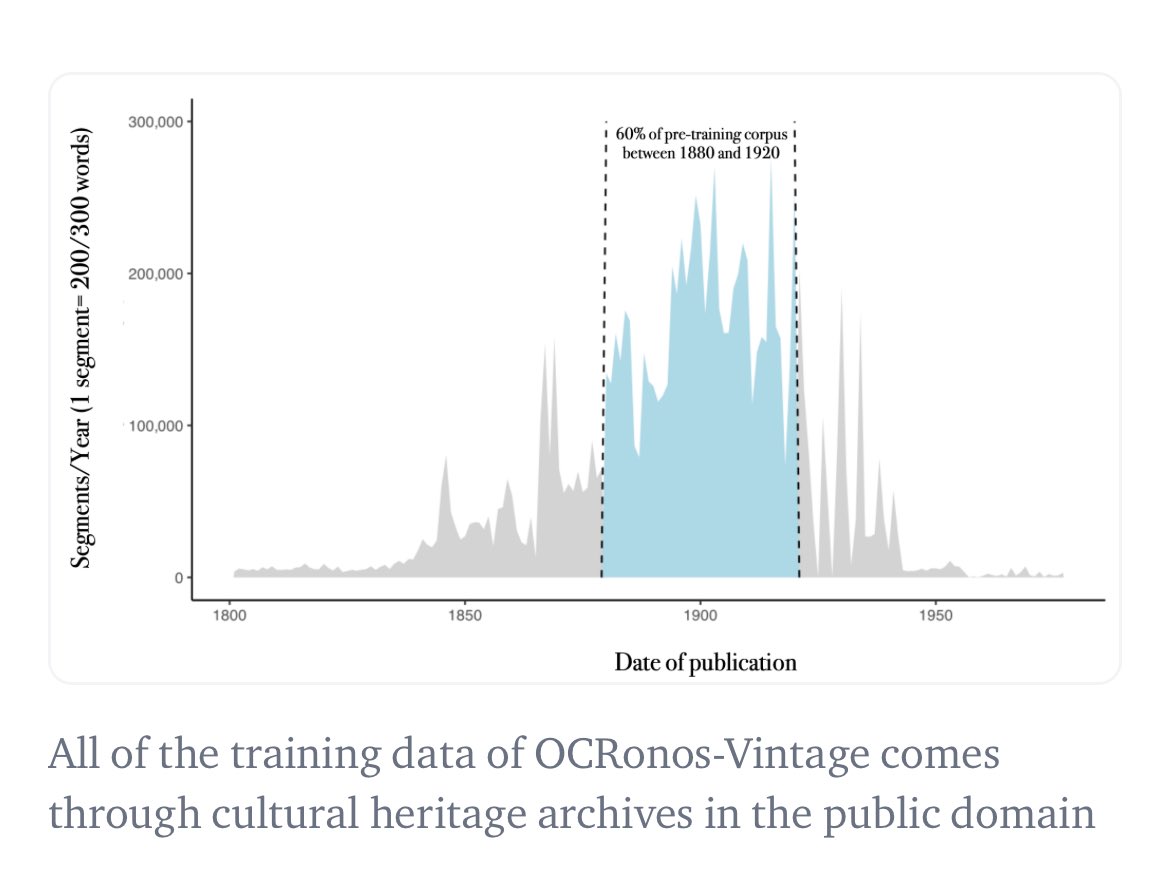

実は、史上初の歴史的LLMを学習させたのは私だと思います。OCR補正モデル「ocronos」は1950年以前にロックされた完全な事前学習済みで、ベースモデルモードで使用できました。主にChronicle Americaの新聞記事をソースとしています。

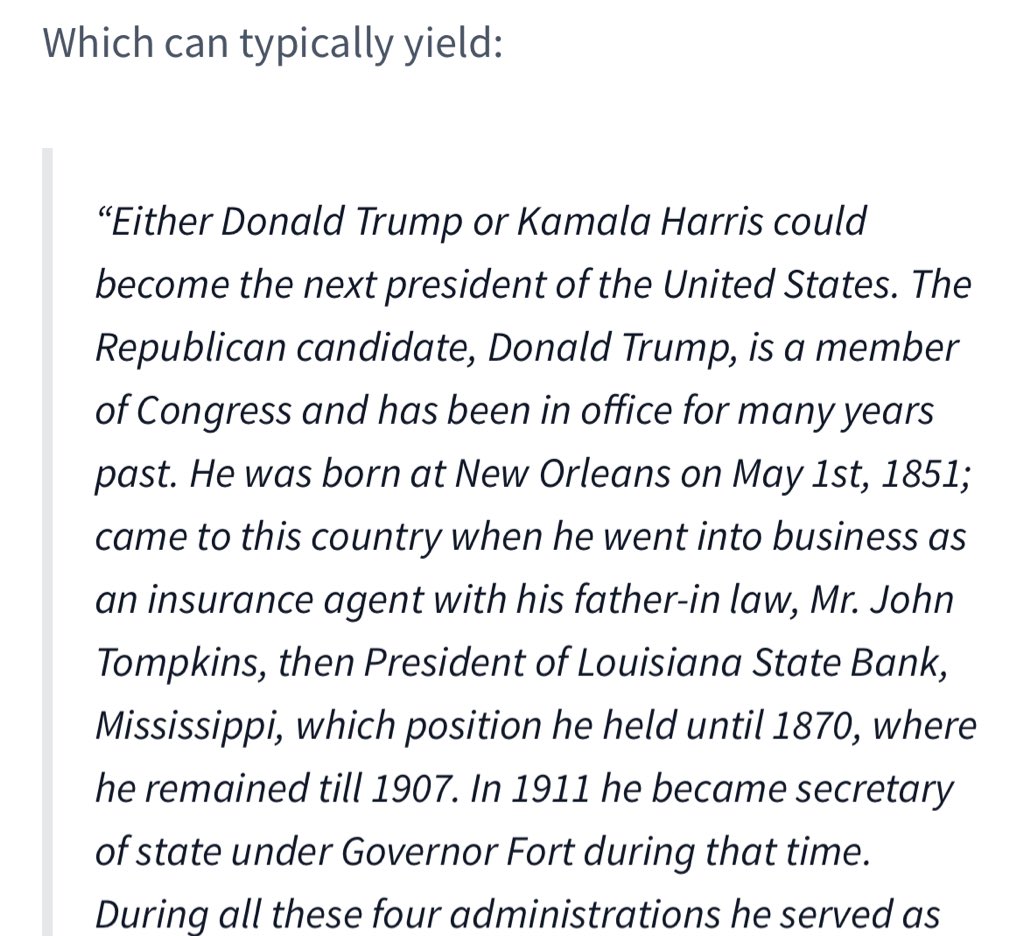

歴史的に根拠のある世代の例(モデルはトランプが誰なのか全く知らず、20世紀初頭に逆戻りする)。このモデルはHFで今でも人気があるようです。https://t.co/1ye5VEGerd

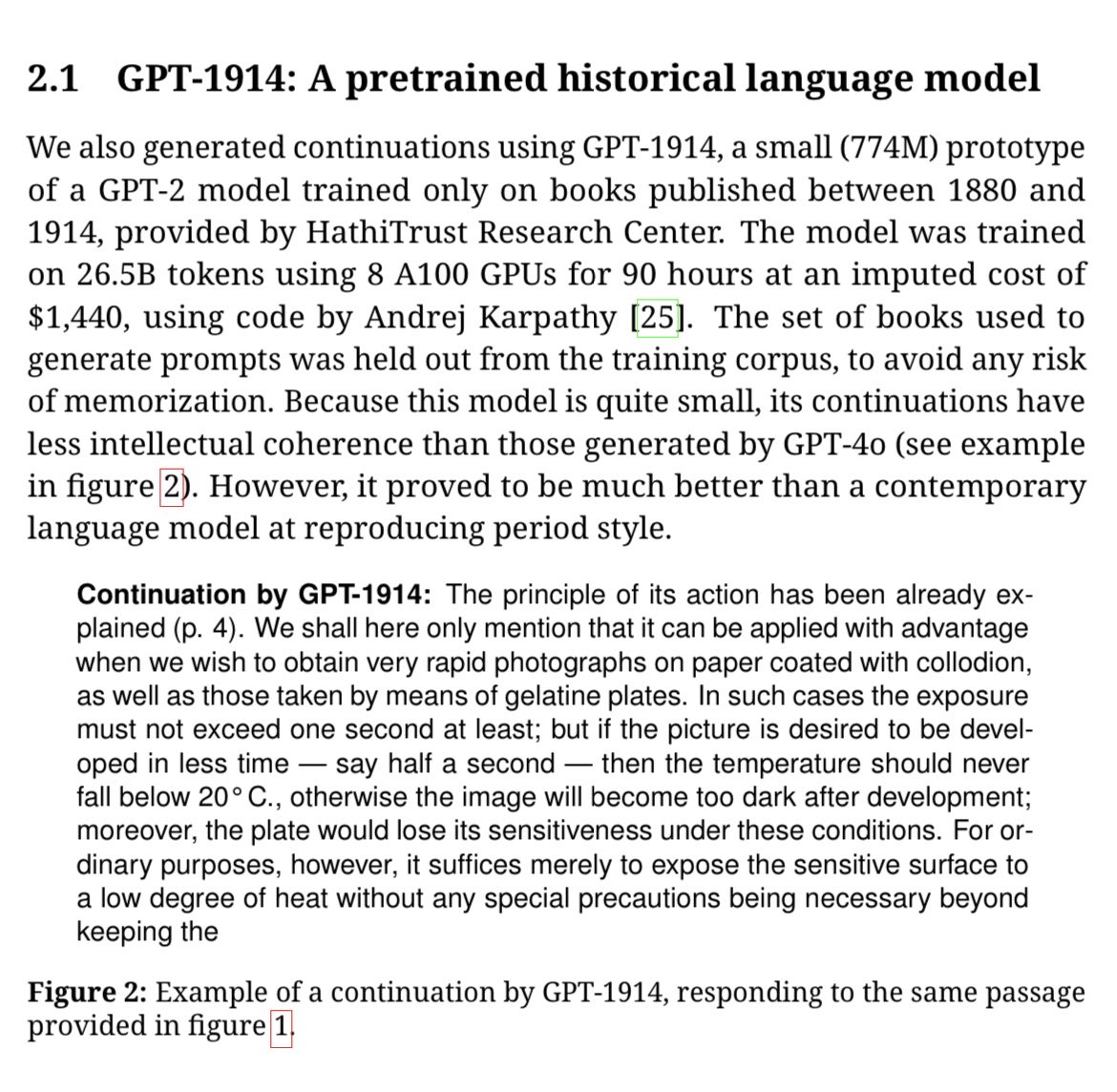

Ted UnderwoodらはGPT-1914もトレーニングしましたが、これはおそらく現在でも最大の歴史的モデル(約8億)です。https://t.co/wSA1WCmz2D