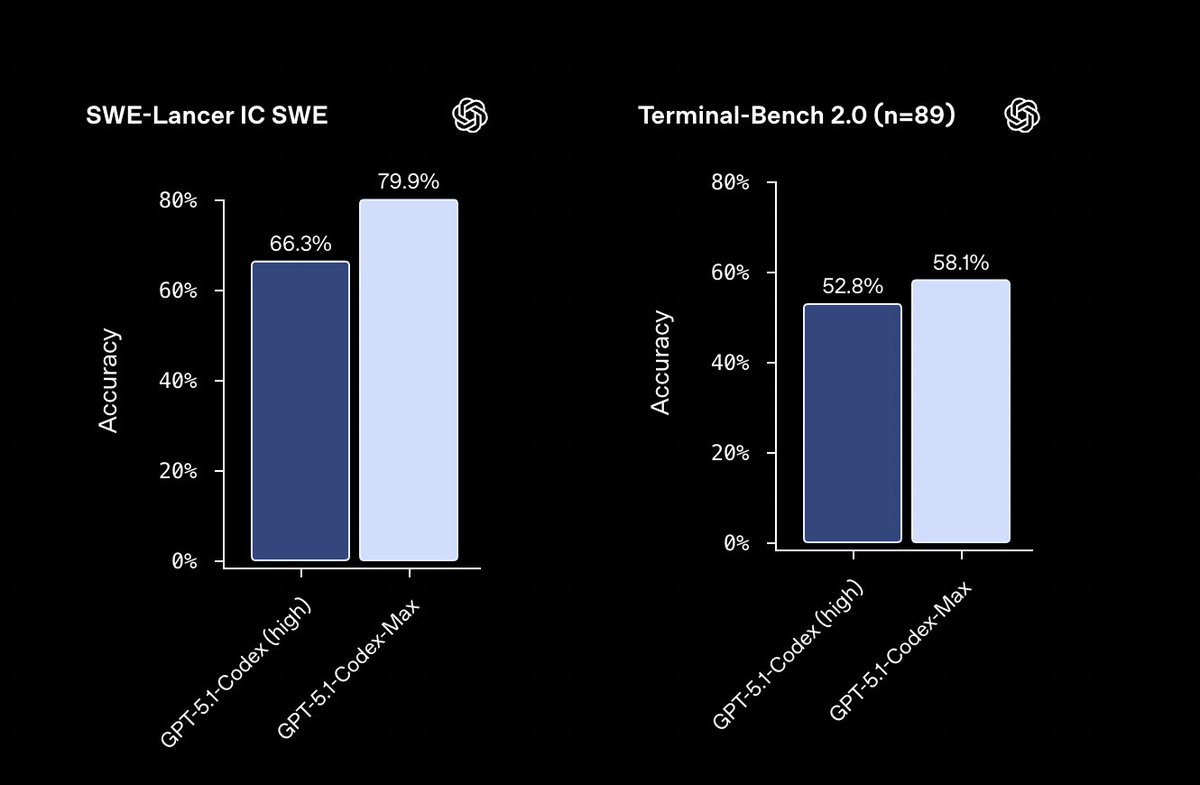

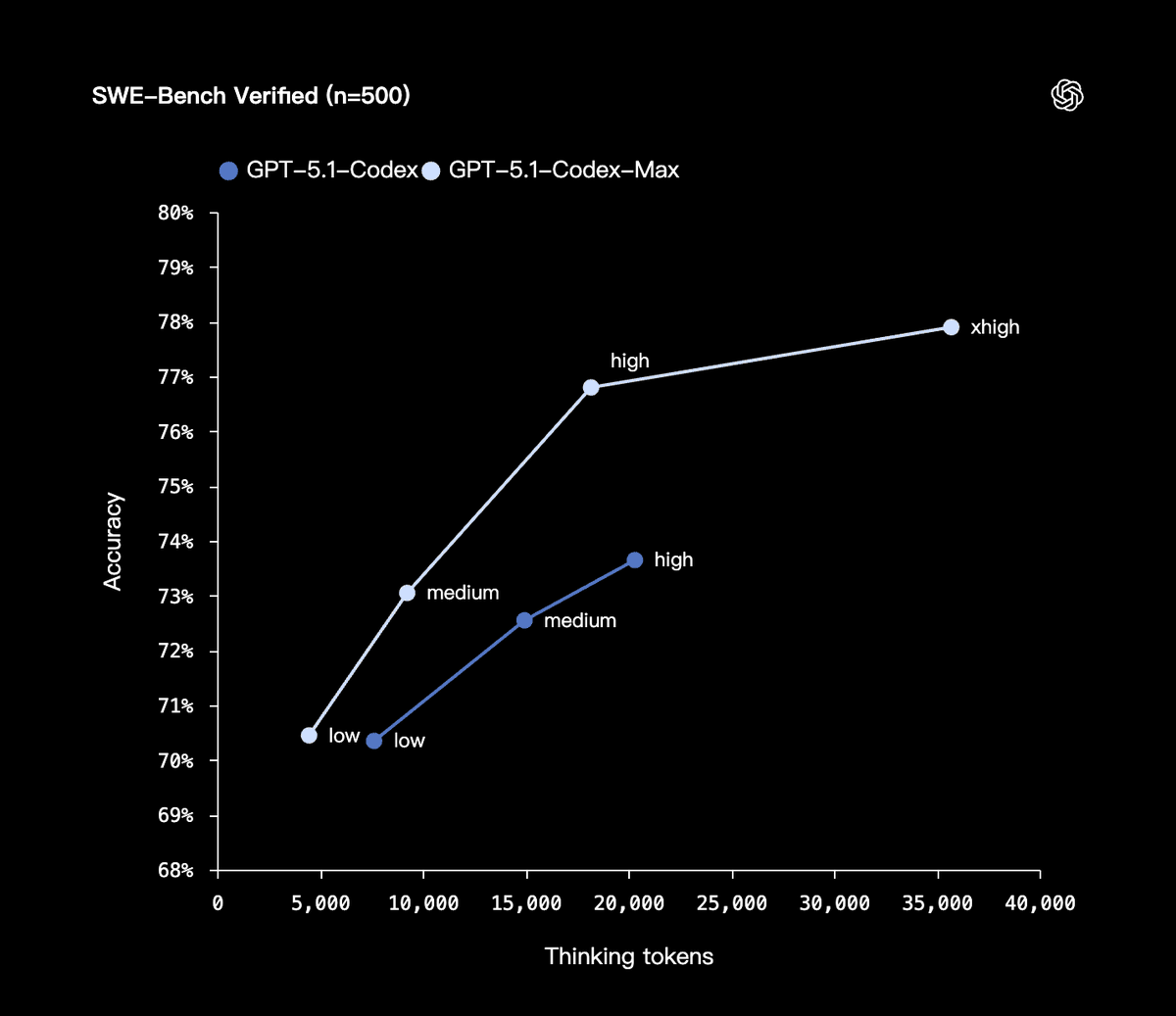

OpenAIは、非常に大規模なコードベースと長い開発サイクルに対処するように設計された新しいコードモデル「GPT-5.1-Codex-Max」をリリースしました。これにより、処理速度とトークン効率が向上し、数十時間分の作業を一度に完了できるようになります。 SWE-bench 検証率は 77.9% に達し、前世代より 4% 向上しました。 トークンについて考えると、同じ品質の他のトークンに比べて 30% 節約できます。 Codex-Max は複雑なタスクを理解し、自律的に計画、実行し、反復的に修正することができます。 数百万のトークンのコンテキストを合理化し、さらなる書き込みのためのスペースを作成できる新しい圧縮メカニズムを採用しているため、情報の損失なしに 24 時間連続して反復できます。 内部的には、Codex CLI リポジトリ全体を独自に再構築し、24 時間ループして障害をテストし、修正して再実行し、最終的に配信しました。 GPT-5.1-Codex-Max は GPT-5.1-Codex に取って代わり、Codex インターフェースのデフォルト モデルになります。 #openai #GPTCodexMax

スレッドを読み込み中

X から元のツイートを取得し、読みやすいビューを準備しています。

通常は数秒で完了しますので、お待ちください。