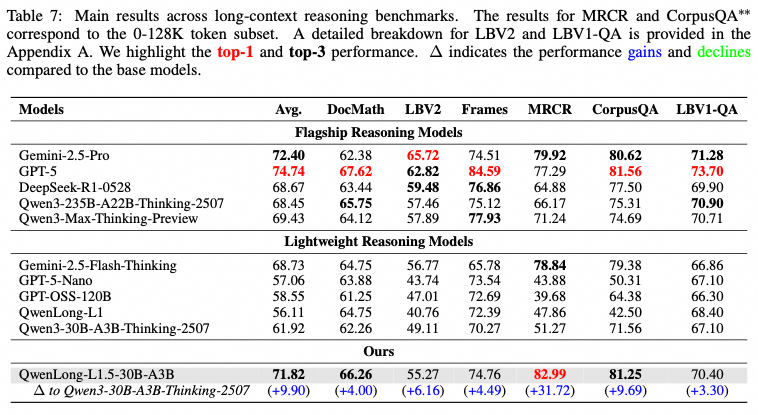

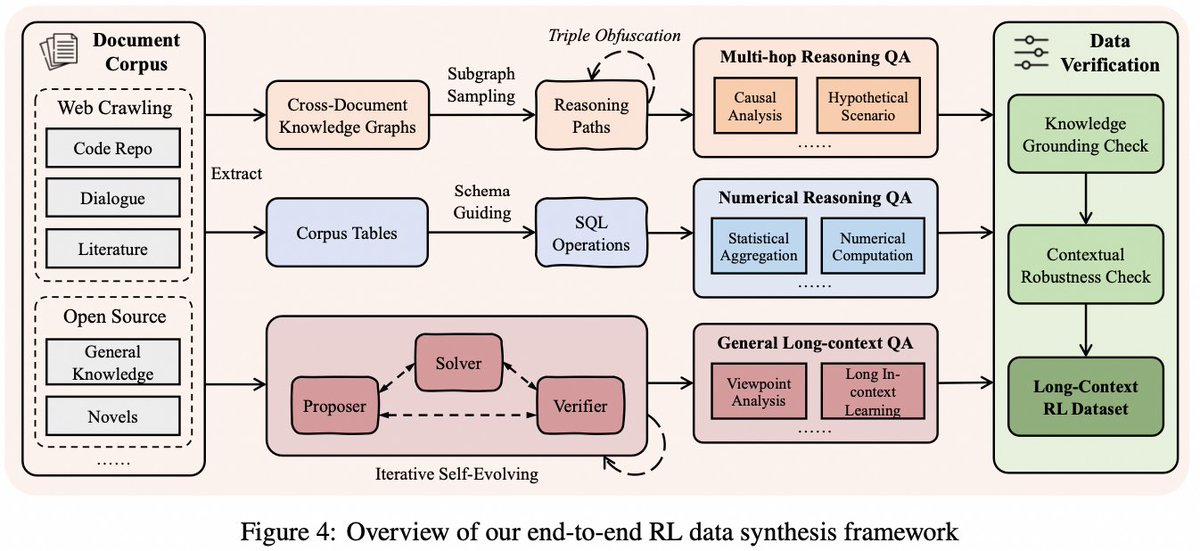

Alibaba a publié un nouveau modèle open source, QwenLong-L1.5, doté d'une gestion du contexte et de la mémoire ultra-longue. Ses performances sont en moyenne supérieures de 9,9 points à celles de Qwen3-30B-A3B-Thinking. C'est comme si vous pouviez y intégrer un manuel complet, un rapport financier exhaustif et des dispositions légales, le tout en une seule fois, et le laisser gérer les questions-réponses inter-chapitres, rédiger des résumés et extraire des clauses. QwenLong-L1.5 est basé sur Qwen3-30B-A3B-Thinking et introduit un mécanisme de mémoire pour lui permettre de gérer des tâches qui dépassent largement la longueur de la fenêtre de contexte physique. Une solution open source complète pour les modèles L1.5 post-entraînement avec raisonnement contextuel long et gestion de la mémoire, unifiant la synthèse des données, les méthodes d'entraînement et l'architecture de l'agent. #QwenLongL15 #LongContextModel

github:github.com/Tongyi-Zhiwen/…