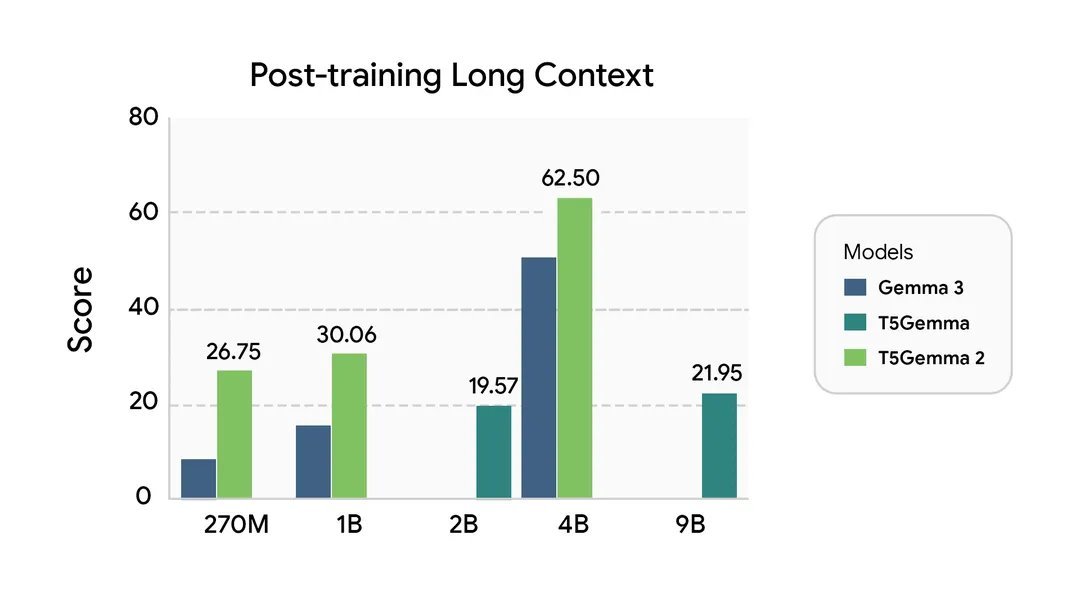

Google a récemment rendu open source son modèle d'encodeur-décodeur multimodal à contexte long T5Gemma 2, qui prend en charge nativement plus de 140 langues et a une taille minimale de 270 Mo. Basé sur Gemma 3, il surpasse Gemma 3 de même taille et le T5 Gemma de première génération dans des tâches telles que le codage, le raisonnement, l'analyse factuelle, le traitement multilingue, le traitement multimodal et le traitement de textes longs. Le T5Gemma 2 est livré avec un encodeur visuel intégré, permettant la réponse aux questions basées sur l'image et le raisonnement mixte image-texte. Tirant parti du mécanisme d'attention local et global de Gemma 3, il peut traiter 128 000 jetons à la fois, ce qui lui permet de gérer de longs documents et de longues conversations. Les modèles encodeur-décodeur sont mieux adaptés aux tâches de séquence à séquence et peuvent être utilisés pour construire des outils de traduction, des systèmes de service client intelligents, des systèmes de questions-réponses basés sur l'image, et bien plus encore. #T5Gemma2 #googleGemma

Modhuggingface.co/collections/go…ScIKblog.google/technology/dev…/RtUAT6iXci