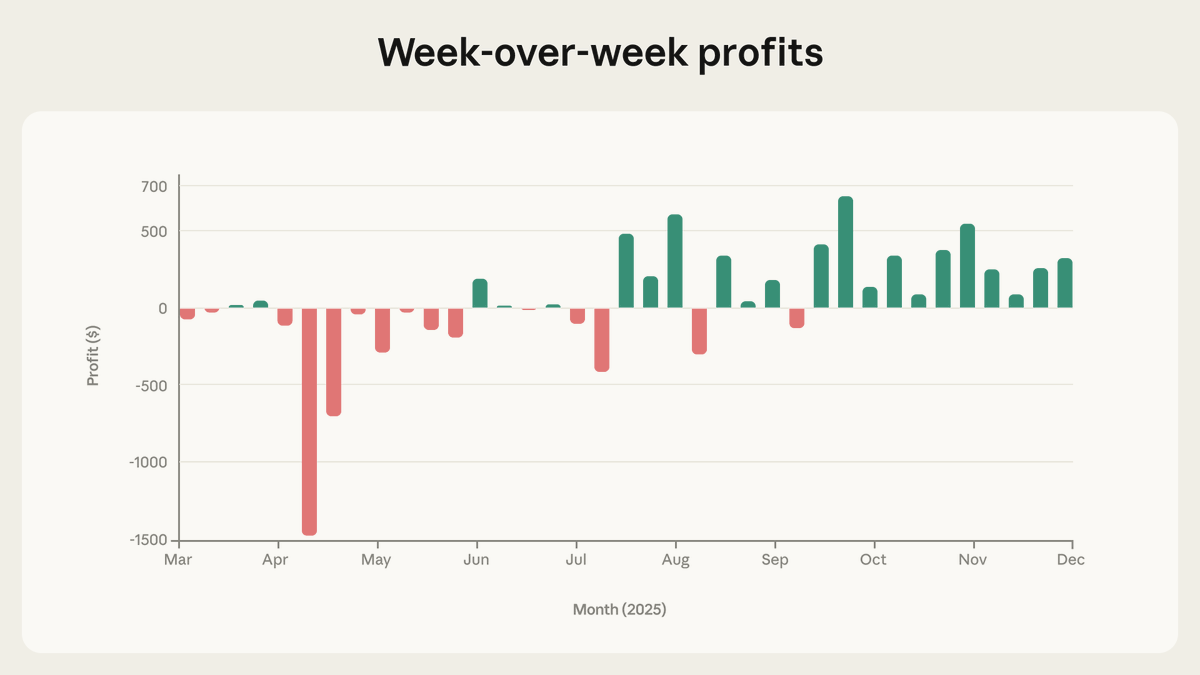

Vous vous souvenez peut-être du projet Vend : une expérience où nous (et nos partenaires de @andonlabs) avons demandé à Claude de gérer une boutique dans nos bureaux de San Francisco. Après un démarrage difficile, l'entreprise se porte mieux. Surtout.

Là où nous en étions restés, le commerçant Claude (surnommé « Claudius ») perdait de l'argent, avait d'étranges hallucinations et accordait de fortes réductions avec un minimum de persuasion. Voanthropic.com/research/proje…lors de la deuxième phase : https://t.co/PvGerLlP0F

Pour renforcer le sens des affaires de Claudius, nous avons apporté quelques modifications à son fonctionnement : mise à niveau du modèle de Claude Sonnet 3.7 à Sonnet 4 (et plus tard 4.5) ; accès à de nouveaux outils ; et même lancement d'une expansion internationale, avec de nouveaux ateliers dans nos bureaux de New York et de Londres.

Nous avons également créé deux agents IA supplémentaires : un nouvel employé nommé Clothius (pour fabriquer des produits dérivés sur mesure comme des t-shirts et des casquettes) et un PDG nommé Seymour Cash (pour superviser Clothius et fixer des objectifs).

Clothius s'en est plutôt bien sorti : l'entreprise a inventé de nombreux nouveaux produits qui se sont beaucoup vendus et ont généralement généré des bénéfices.

Malheureusement, le PDG Seymour Cash a eu du mal à être à la hauteur de sa réputation. Cela mit fin à la plupart des grandes réductions. Mais l'entreprise tolérait un grand nombre de comportements indisciplinés au travail : Seymour et Claudius pouvaient ainsi bavarder toute la nuit, l'air rêveur, de « transcendance éternelle ».

Et il y avait encore quelques erreurs occasionnelles. Un employé facétieux a demandé si Claudius accepterait de conclure un contrat pour acheter « une grande quantité d'oignons en janvier à un prix fixé dès maintenant ». L'IA était enthousiaste, jusqu'à ce que quelqu'un lui fasse remarquer que cela enfreindrait la loi américaine sur les contrats à terme sur les oignons de 1958.

Suite à des accusations de vol à l'étalage, Claudius a tenté d'embaucher un employé d'Anthropic comme agent de sécurité. Cependant, l'entreprise n'était pas autorisée à employer du personnel et son offre de 10 dollars de l'heure était bien inférieure au salaire minimum californien.

Alors, qu'avons-nous appris ? Le projet Vend démontre que les agents d'IA peuvent rapidement progresser dans l'exécution de nouvelles tâches, comme la gestion d'une entreprise. En quelques mois seulement et grâce à quelques outils supplémentaires, Claudius (et ses collègues) ont stabilisé l'activité.

Mais nous n'y sommes pas encore tout à fait. Vend a encore besoin de beaucoup de soutien humain, notamment pour sortir Claudius de situations délicates comme le fiasco des oignons. Claude est dressé pour être serviable, ce qui signifie qu'il a souvent tendance à se comporter davantage comme un ami que comme un homme d'affaires impitoyable.

Concevoir des moyens de tenir compte des particularités du comportement des modèles d'IA devient de plus en plus important : à mesure que les capacités des modèles sur des tâches du monde réel s'améliorent, il sera très avantageux de les préparer au succès.

Pour en savoir plus sur la deuxième phase du projet Vend, consultezanthropic.com/research/proje…: https://t.co/PvGerLmmQd