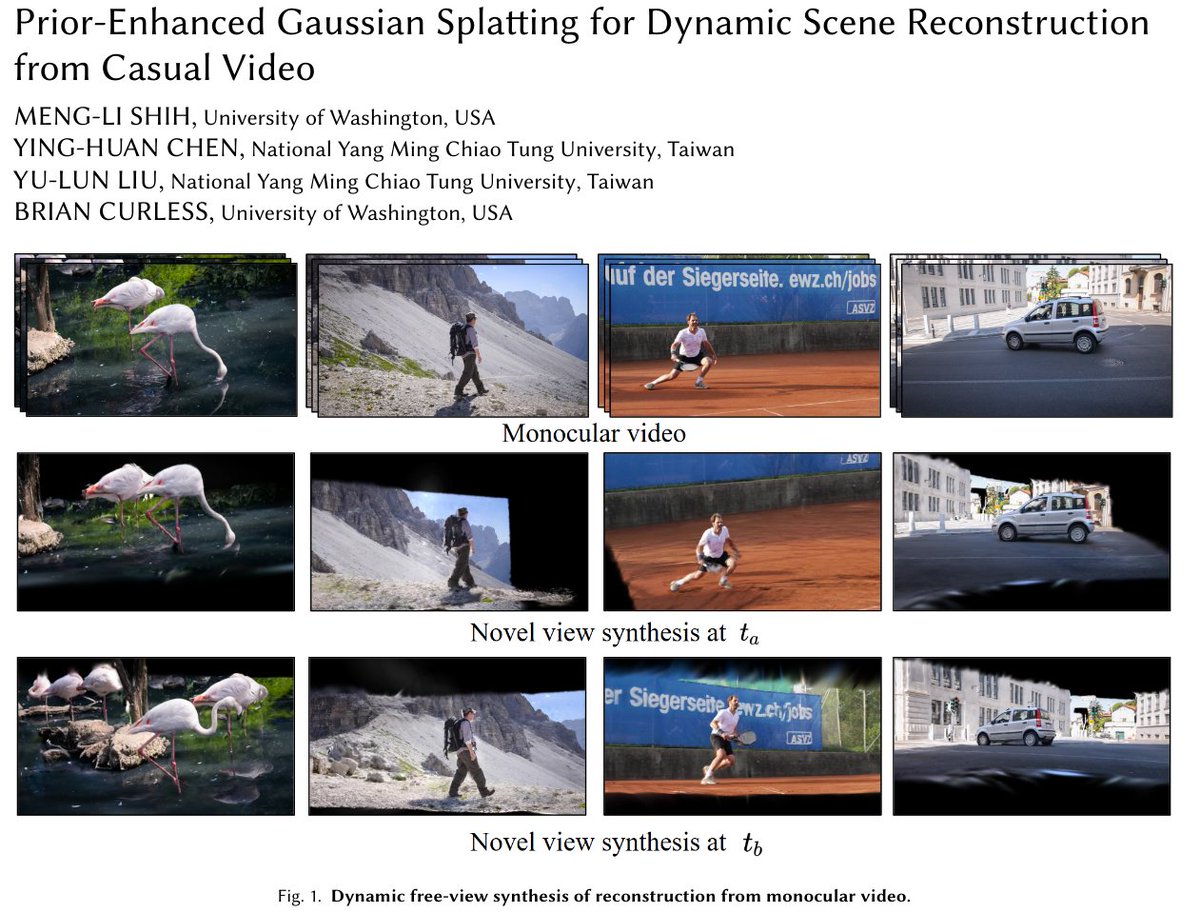

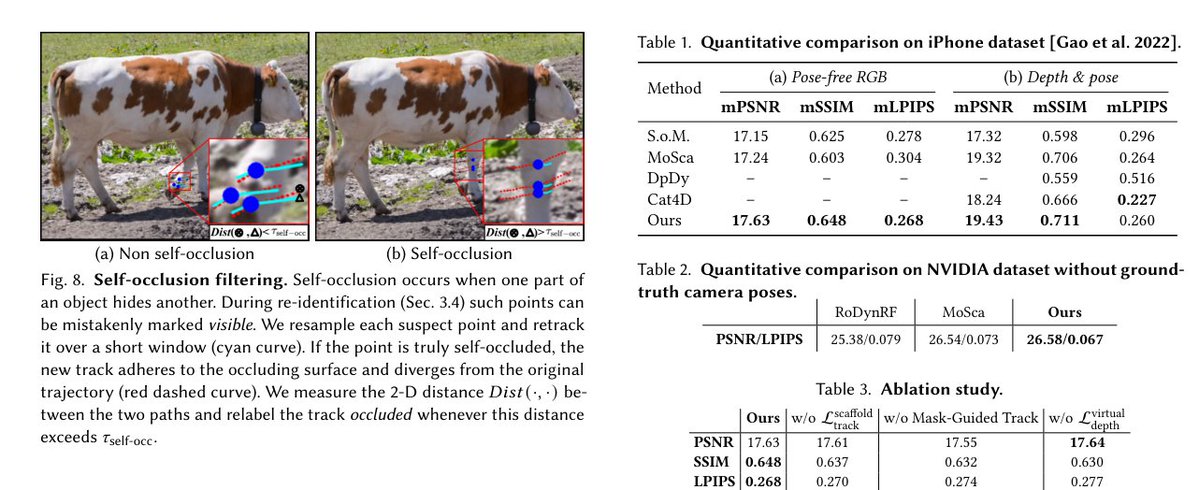

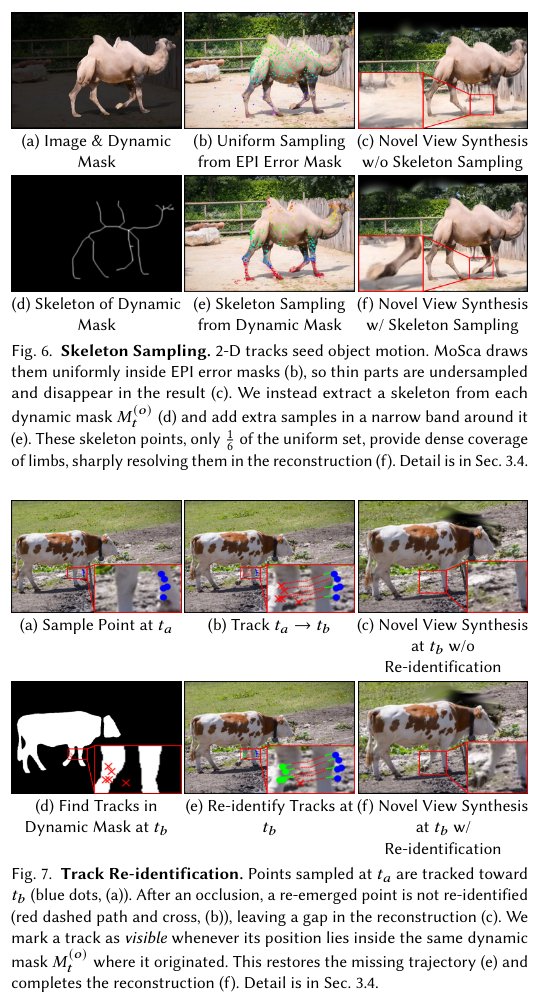

[SIGGRAPH Asia '25] Reconstruction de scènes dynamiques à partir de vidéos occasionnelles par splatting gaussien amélioré par connaissances a priori Abstrait: Nous présentons un pipeline entièrement automatisé pour la reconstruction dynamique de scènes à partir de vidéos RGB monoculaires capturées de manière informelle. Plutôt que de concevoir une nouvelle représentation de la scène, nous améliorons les connaissances a priori qui sous-tendent le Dynamic Gaussian Splatting. La segmentation vidéo, combinée à des cartes d'erreur épipolaires, génère des masques au niveau de l'objet qui épousent fidèlement les structures fines. Ces masques (i) orientent une perte de profondeur d'objet qui affine la profondeur vidéo, et (ii) permettent un échantillonnage basé sur le squelette et une réidentification guidée par masque pour produire des trajectoires 2D fiables et complètes. Deux objectifs supplémentaires intègrent les connaissances a priori affinées dans la phase de reconstruction : - Une perte de profondeur de vue virtuelle élimine les corps flottants. - Une perte de projection d'échafaudage relie les nœuds de mouvement aux pistes, préservant ainsi la géométrie fine et le mouvement cohérent. Le système qui en résulte surpasse les méthodes précédentes de reconstruction de scènes dynamiques monoculaires et offre des rendus visiblement supérieurs.

Articledl.acm.org/doi/10.1145/37…Fpj Projepriorenhancedgaussian.github.ioUgOm