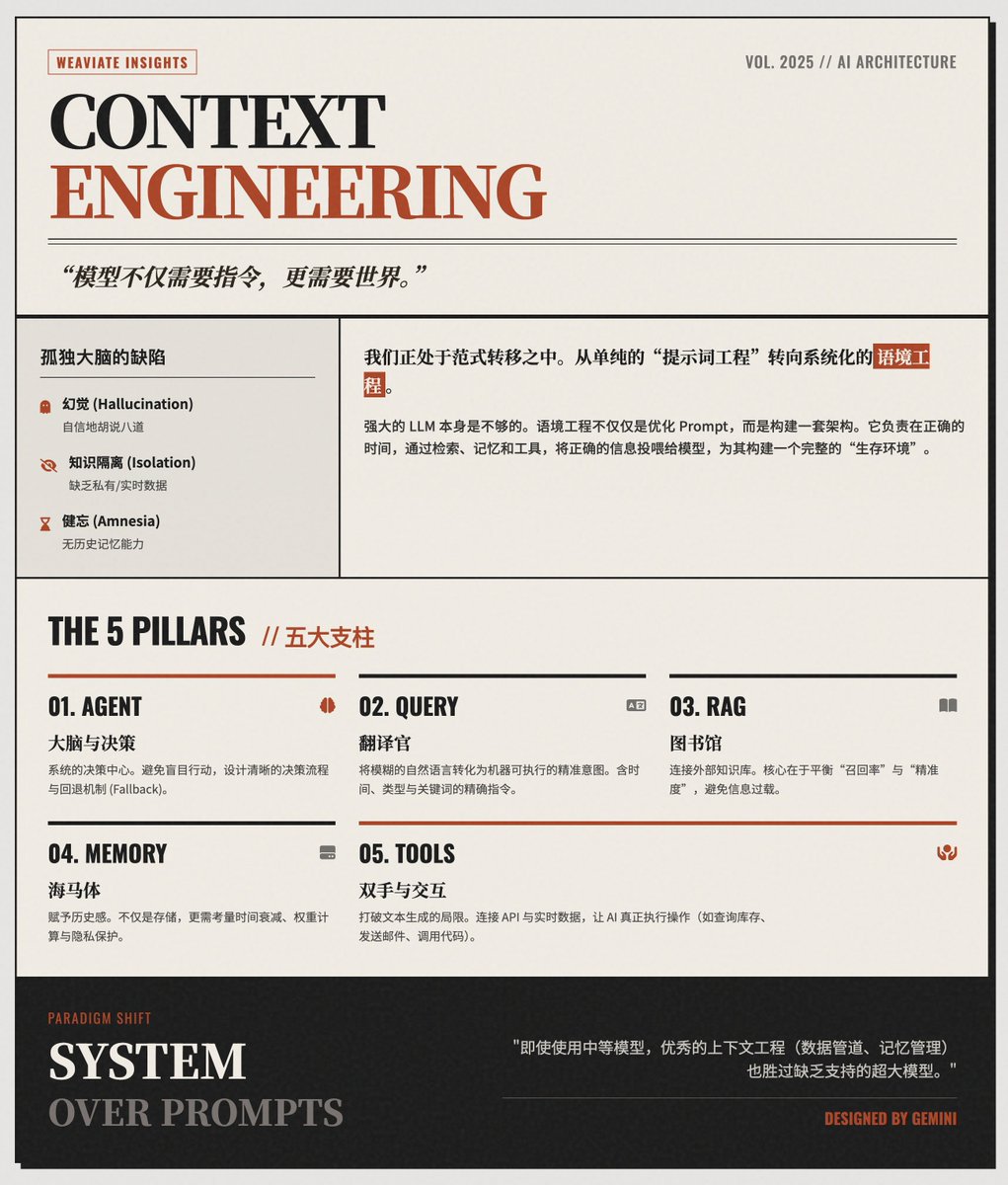

Ingénierie du contexte pour les agents d'IA Le dernier article de blog de @weaviate_io réexamine en profondeur l'« ingénierie du contexte » dans les agents d'IA, en construisant un environnement vivant complet pour le modèle, incluant mémoire, outils et base de connaissances. Les illustrations sont toujours aussi pertinentes et facilitent grandement la compréhension de la théorie et des méthodes. Je recommande à mes amis de lire l'article original. Point clé à retenir : les modèles ont besoin non seulement d’« instructions », mais aussi d’un « monde ». Cela soulève un point contre-intuitif mais crucial : un puissant LLM ne suffit pas à lui seul. Même les modèles les plus performants sont des « cerveaux isolés ». Ils présentent trois défauts majeurs inhérents : • Illusion : Débiter des absurdités avec assurance. • Isolement des connaissances : absence de données privées spécifiques ou de connaissances du monde en temps réel. • Aucun souvenir : Impossible de se rappeler de la conversation de la seconde précédente. L'ingénierie contextuelle est précisément conçue pour résoudre ces problèmes : Il ne s'agit pas seulement de rédiger de meilleures invites ; il s'agit de construire une architecture qui garantisse que les bonnes informations soient fournies au modèle au bon moment. Son objectif est de relier les modèles isolés au monde réel, en leur donnant un « contexte » complet lors du raisonnement. L'article « Les cinq piliers de l'ingénierie contextuelle » décompose l'ingénierie contextuelle en cinq modèles architecturaux fondamentaux, qui servent également de plan directeur pour la création d'applications d'IA prêtes pour la production : • Agent : Le cerveau, qui fait office de centre de décision du système ; pour éviter que le modèle n'agisse aveuglément, un processus de décision clair et un mécanisme de repli doivent être conçus. • Augmentation des requêtes : Un traducteur qui transforme le langage naturel ambigu de l’utilisateur en intentions précises et exécutables par machine ; par exemple, transformer « Trouver le document mentionné lors de la réunion de la semaine dernière » en une instruction de recherche précise comprenant l’heure, le type de document et les mots clés. • Recherche : Une bibliothèque qui se connecte à des bases de connaissances externes ; son principe fondamental repose sur l'équilibre entre « rappel » et « exactitude » afin d'éviter la surcharge d'informations ou l'omission d'informations clés. • Mémoire : L’hippocampe confère au système une notion d’histoire et une capacité d’apprentissage ; la mémoire n’est pas simplement un stockage de données, mais doit prendre en compte la dégradation temporelle, la pondération de l’importance et la protection de la vie privée. • Outils : Permettre à l'IA d'interagir avec des données en temps réel et des API ; permettre à l'IA d'aller au-delà de la simple génération de texte et d'effectuer réellement des opérations (telles que la vérification des stocks ou l'envoi d'e-mails). Changement de paradigme méthodologique : Passé (Ingénierie des mots-clés) : Ne pas se fier uniquement à l’intelligence du modèle lui-même, mais aussi passer beaucoup de temps à ajuster le libellé de l’invite. • Maintenant (Ingénierie du contexte) : concentrez-vous sur la conception du système. Même avec un modèle de taille de paramètres moyenne, si l’ingénierie du contexte (pipeline de données, qualité de la récupération, gestion de la mémoire) est bien réalisée, elle surpasse souvent un système qui utilise simplement un très grand modèle mais qui manque de prise en charge du contexte. Lire le texte original

Chargement du thread

Récupération des tweets originaux depuis X pour offrir une lecture épurée.

Cela ne prend généralement que quelques secondes.