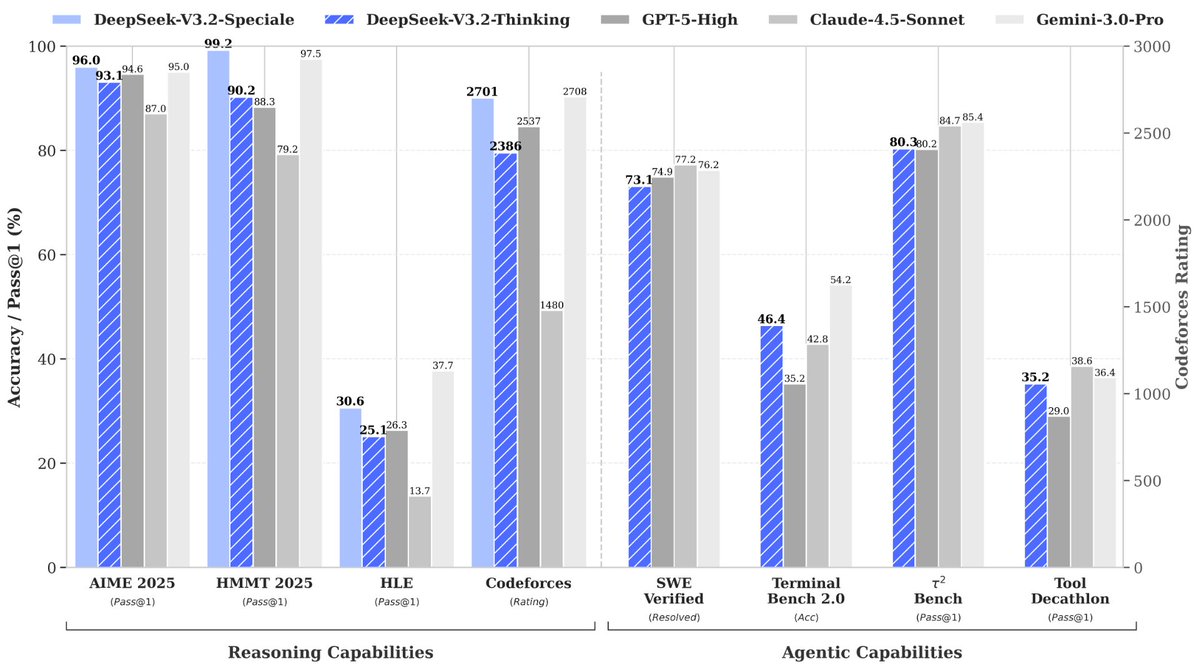

DeepSeek vient de publier son dernier modèle V3.2, qui met l'accent sur une inférence efficace et des capacités d'agent puissantes. L'introduction du mécanisme d'attention parcimonieuse (DSA) réduit considérablement la complexité de calcul tout en maintenant les performances du modèle, et est spécifiquement optimisée pour les scénarios de contexte long. Une avancée majeure a été réalisée dans la synthèse de tâches d'agents à grande échelle, intégrant des capacités de raisonnement dans les scénarios d'invocation d'outils et améliorant considérablement les performances du modèle dans des environnements interactifs complexes. Adresse du modèle : https://t.co/VwGFgEylOz Dans le même temps, une version améliorée, DeepSeek-V3.2-Speciale, a également été lancée, et ses performances étaient encore plus remarquables. Grâce au soutien d'un cadre d'apprentissage par renforcement, sa capacité de raisonnement surpasserait celle de GPT-5 et serait comparable à celle de Gemini-3.0-pro, et il a remporté des médailles d'or dans des compétitions internationales telles que l'IMO 2025 et l'IOI. Adresse du modèle : https://t.co/yWt5pX9UH2 De plus, le modèle de conversation a été mis à jour pour prendre en charge la fonctionnalité « penser avec des outils », et un nouveau rôle de développeur a été ajouté spécifiquement pour l'agent de recherche. Globalement, cette mise à jour de DeepSeek est assez conséquente et mérite qu'on s'y attarde.

Chargement du thread

Récupération des tweets originaux depuis X pour offrir une lecture épurée.

Cela ne prend généralement que quelques secondes.