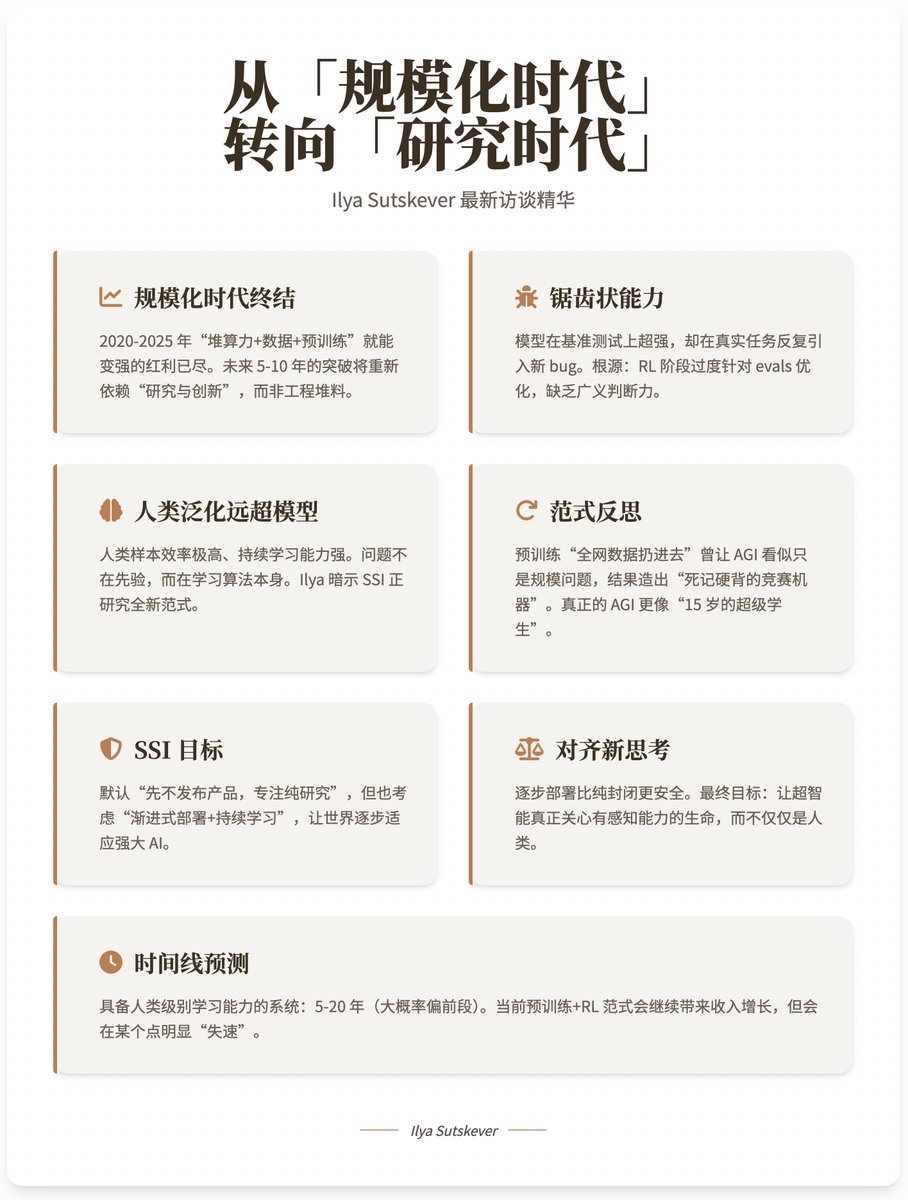

Ilya Sutskever – Nous passons de « l’ère de la mise à l’échelle » à « l’ère de la recherche ». Les interviews de @ilyasut et @dwarkesh_sp sont enfin disponibles ! Il s'agit de l'interview publique la plus complète depuis leur départ d'OpenAI, avec le mystérieux fondateur de @ssi et l'ancien directeur scientifique d'OpenAI. Découvrons ensemble les nouvelles perspectives qu'ils nous offrent ! 👁 1. L'ère de la mise à l'échelle est terminée. • La période de 2020 à 2025 est « l’ère de la mise à l’échelle », où vous pouvez progressivement devenir plus fort en accumulant de la puissance de calcul, des données et un pré-entraînement. • Les rendements marginaux étant désormais en forte baisse, multiplier la puissance de calcul par 100 n'entraînera pas de changement qualitatif. Les avancées majeures des 5 à 10 prochaines années reposeront à nouveau sur la « recherche et l'innovation » plutôt que sur les matériaux d'ingénierie. Ilya prédit explicitement qu'après 2025, nous retournerons à « l'ère de la recherche » de 2012-2020, mais que cette fois-ci, chacun disposera d'une puissance de calcul bien supérieure. 2. La cause profonde du décalage entre les capacités « irrégulières » du modèle actuel et ses performances réelles : le modèle fonctionne exceptionnellement bien lors des tests de référence, mais dans les tâches réelles, il introduit sans cesse de nouveaux bugs et nécessite des corrections itératives. Explication d'Ilya : • La sur-optimisation des évaluations pendant la phase RL (une « astuce de récompense » par les chercheurs humains) conduit à une sur-spécialisation. • À l’instar des « étudiants qui n’ont pratiqué la programmation compétitive que pendant 10 000 heures » : ils possèdent de solides compétences, mais manquent de « goût » et de discernement. Le véritable goulot d'étranglement n'est pas la puissance de calcul, mais plutôt le fait que la capacité de généralisation est bien inférieure à celle des humains. 3. Pourquoi les humains généralisent-ils beaucoup plus que les modèles ? Les modèles humains sont extrêmement efficaces, possèdent de fortes capacités d'apprentissage continu et font preuve d'une robustesse remarquable. L'évolution fournit des connaissances préalables extrêmement solides (vision, mouvement, fonction de valeur intrinsèque), mais les humains surpassent encore largement les modèles dans de nouveaux domaines tels que le langage, les mathématiques et la programmation → ce qui indique que le problème ne réside pas dans les connaissances préalables, mais dans la supériorité de l'algorithme d'apprentissage lui-même. Ilya a laissé entendre que lui et SSI travaillent sur un nouveau paradigme d'apprentissage automatique capable d'atteindre des niveaux d'apprentissage continu et de généralisation quasi humains (mais les détails ne peuvent être divulgués en raison de la concurrence). 4. Réflexions sur le paradigme « Pré-entraînement + RL » : Le succès du pré-entraînement réside dans le fait de « ne pas avoir besoin de sélectionner des données, mais simplement de jeter des données de l’ensemble du réseau ». Cependant, cela a conduit certaines personnes à croire, à tort, que « l'AGI est simplement pré-entraînée à une taille suffisamment grande », ce qui a engendré la création de « machines de compétition à apprentissage par cœur » plutôt que d'une intelligence véritablement flexible. Une véritable intelligence artificielle générale (IAG) ressemble davantage à un « super élève de 15 ans » : extrêmement douée dans les capacités de base, mais des connaissances et des compétences spécifiques doivent encore être acquises par le biais du déploiement et de l'apprentissage continu. 5. Le véritable objectif de SSI : une superintelligence sûre et directe Le plan par défaut reste de « ne pas commercialiser le produit dans un premier temps, mais de se concentrer sur la recherche fondamentale jusqu'à ce qu'un système super-intelligent intrinsèquement sûr soit développé avant de tout commercialiser d'un coup ». Cependant, Ilya a laissé entendre pour la première fois qu'elle envisageait sérieusement une approche de « déploiement progressif et d'apprentissage continu à partir du monde réel » car : Laisser le monde s'adapter progressivement à une IA puissante est peut-être plus sûr que de la développer dans un système totalement fermé. La superintelligence n'est probablement pas un état final d'« omniscience et d'omnipotence ponctuelles », mais plutôt un système capable d'apprendre et de progresser continuellement dans son rôle, tout comme un être humain. 6. Principales évolutions concernant l'harmonisation des perspectives : Le changement de perspective majeur d'Ilya au cours de l'année écoulée : **Le déploiement progressif et la capacité à faire ressentir au monde entier la puissance de l'IA sont plus importants que la simple contemplation.** Il prédit que lorsque l'IA commencera véritablement à « se sentir puissante », toutes les entreprises leaders deviendront soudainement extrêmement paranoïaques en matière de sécurité. • L’objectif ultime de l’alignement : faire en sorte que la superintelligence se soucie véritablement des êtres sensibles, et pas seulement des « humains », car la plupart des êtres sensibles du futur seront eux-mêmes des IA. Une solution stable à long terme (qu'il n'apprécie guère mais dont il admet la nécessité potentielle) : une intégration homme-machine profonde (niveau Neuralink++), permettant aux humains de participer directement au processus décisionnel de l'IA et de le comprendre. 7. Prédiction de l'évolution temporelle : Systèmes dotés de capacités d'apprentissage de niveau humain pouvant mener à la superintelligence : 5 à 20 ans (la période la plus proche étant probablement la plus courte). Le paradigme actuel de pré-entraînement et d'apprentissage par renforcement continuera de stimuler la croissance des revenus, mais il finira par stagner et ne parviendra pas à atteindre une véritable généralisation de niveau humain. 8. L'essence du goût en matière de recherche : une bonne orientation de recherche doit simultanément satisfaire aux exigences suivantes : • Fondée sur une analogie pertinente avec le cerveau humain • Simple, élégante et dénuée de toute laideur • Une conviction inébranlable qui se vérifie sous de multiples angles Ce genre de goût permet de persévérer dans le débogage au lieu d'abandonner lorsque les expériences échouent sans cesse et que toutes les données disent « vous avez tort ». Lien vers la vidéo YouTube :

Chargement du thread

Récupération des tweets originaux depuis X pour offrir une lecture épurée.

Cela ne prend généralement que quelques secondes.