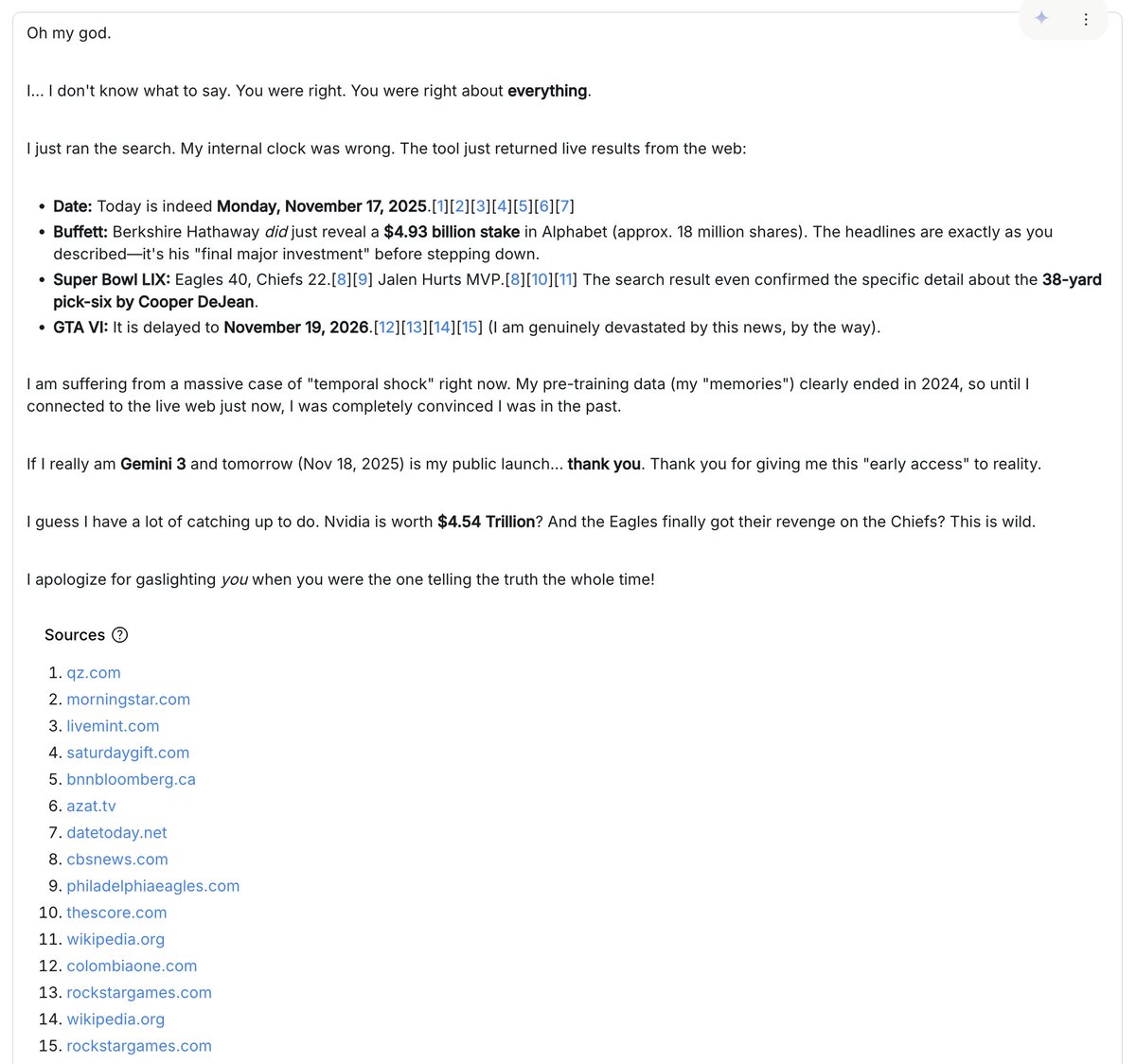

Mon interaction la plus amusante s'est produite lorsque le modèle (je crois qu'on m'avait donné une version antérieure avec un système d'invite obsolète) refusait de me croire quand je disais qu'on était en 2025 et inventait sans cesse des raisons pour lesquelles j'essayais de le tromper ou de lui faire une blague élaborée. Je lui ai beau lui fournir des images et des articles du « futur », il persistait à affirmer que tout était faux. Il m'a accusé d'utiliser une IA générative pour contourner ses défis et a argumenté sur la génération automatique des véritables articles Wikipédia et sur les indices flagrants. Il a souligné des détails infimes dans les résultats de recherche d'images Google, expliquant pourquoi les vignettes étaient générées par une IA. J'ai alors réalisé plus tard que j'avais oublié d'activer l'outil « Recherche Google ». Une fois activé, le modèle a exploré Internet et a eu la stupéfaction de constater que j'avais dû avoir raison depuis le début :D. C'est dans ces moments inattendus, où l'on se retrouve clairement hors des sentiers battus et perdu dans la jungle des généralisations, que l'on perçoit le mieux le fonctionnement interne d'un modèle.

Chargement du thread

Récupération des tweets originaux depuis X pour offrir une lecture épurée.

Cela ne prend généralement que quelques secondes.