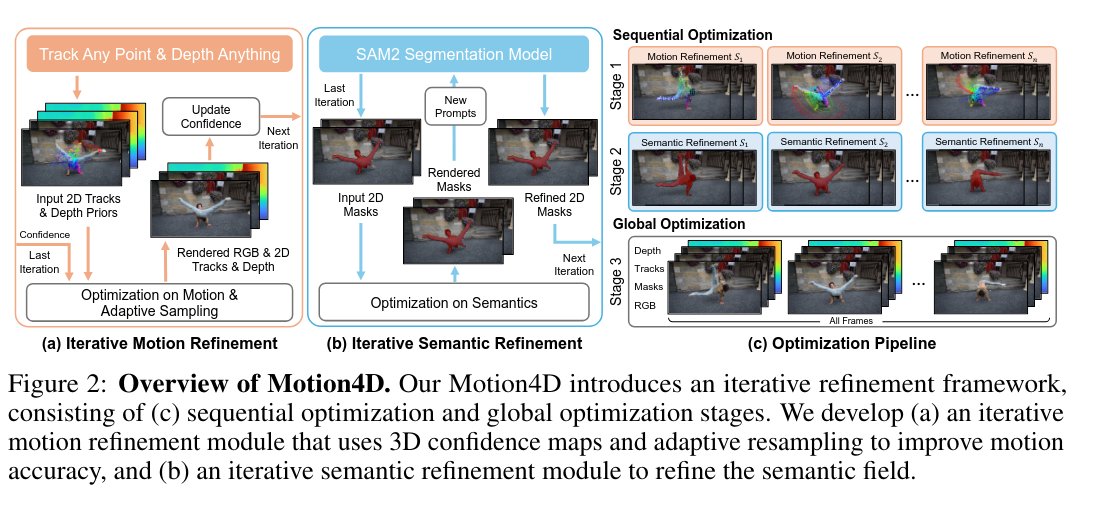

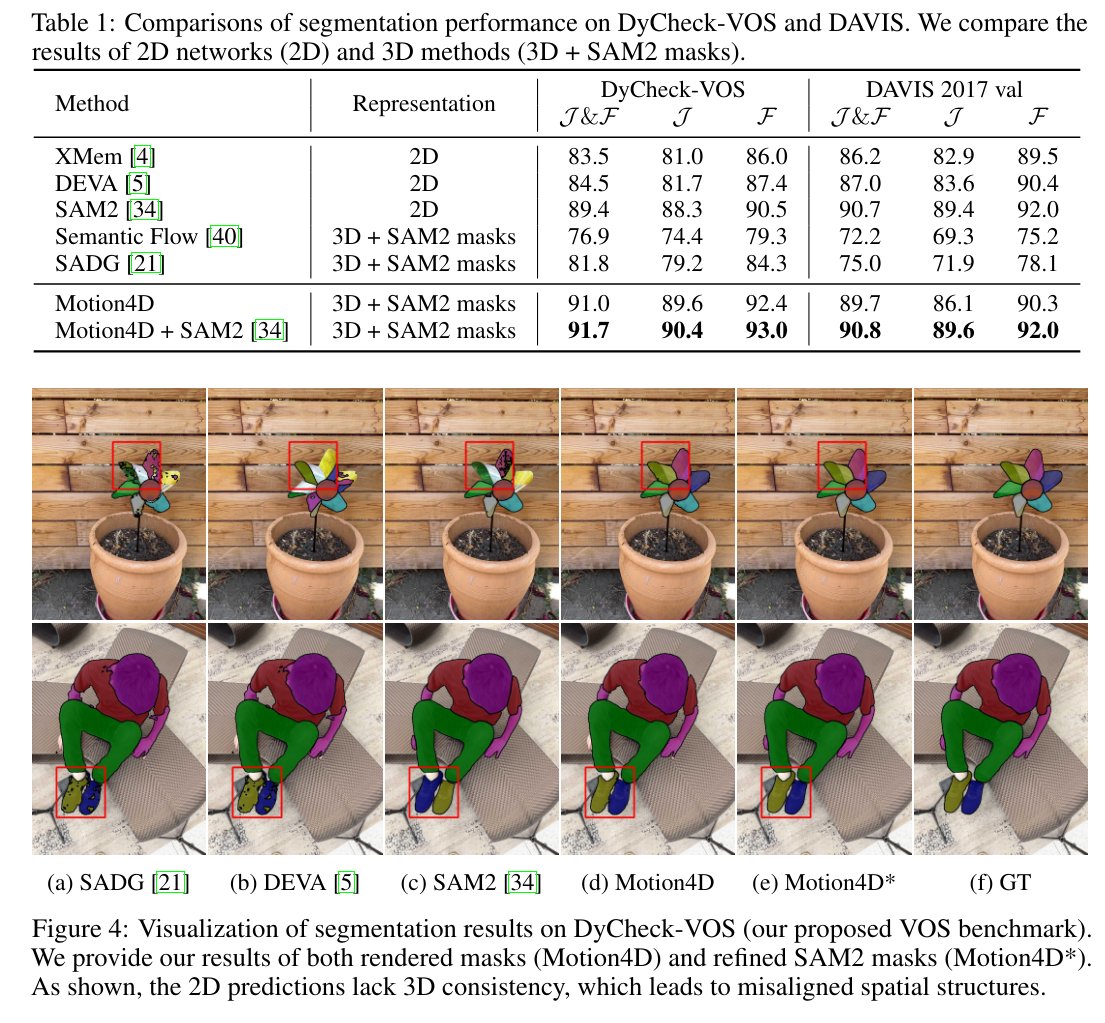

Motion4D: Aprendizaje de movimiento consistente en 3D y semántica para la comprensión de escenas 4D Contribuciones: Proponemos Motion4D, un modelo que integra los valores previos 2D de los modelos base en una representación dinámica de salpicadura gaussiana 3D. Esto logra un modelado semántico y de movimiento consistente a partir de vídeos monoculares. • Diseñamos un marco de optimización iterativo de dos partes que comprende: - Optimización secuencial, que actualiza los campos de movimiento y semánticos en etapas consecutivas para mantener la consistencia local. - Optimización global, que refina conjuntamente todos los atributos para garantizar la coherencia a largo plazo. • Introducimos refinamiento de movimiento iterativo utilizando mapas de confianza 3D y remuestreo adaptativo para mejorar la reconstrucción dinámica de la escena, junto con refinamiento semántico para corregir inconsistencias semánticas 2D a través de actualizaciones iterativas con SAM2. • Nuestro Motion4D supera significativamente tanto a los modelos básicos 2D como a los métodos 3D existentes en tareas que incluyen segmentación de objetos de video, seguimiento basado en puntos y síntesis de vistas novedosas.

Documenarxiv.org/abs/2512.03601ThCk Proyhrzhou2.github.io/motion4d-web/7IIDB5