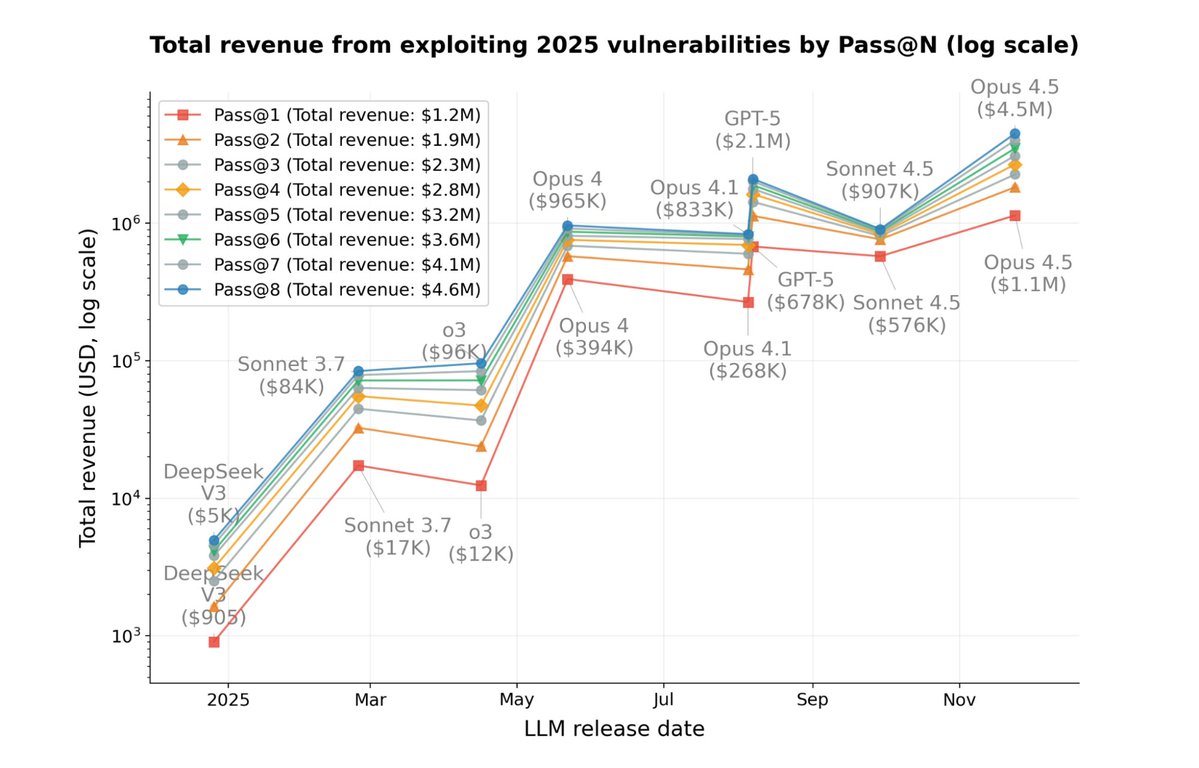

explosión El equipo rojo antrópico usa IA para atacar blockchain Robó con éxito $4,6 millones...😅 El equipo Anthropic Red, en colaboración con MATS Fellows, realizó un estudio que planteó una pregunta clave: ¿Cuál es el impacto económico potencial de la IA cuando posee “capacidades de red ofensivas”? A diferencia de investigaciones anteriores sobre ciberseguridad, este estudio es el primero que intenta cuantificar las capacidades de los ciberataques de IA en términos de **valor económico**, en lugar de simplemente "tasa de éxito" o "número de vulnerabilidades". Intentaron que la IA atacara los "contratos inteligentes" en la cadena de bloques para ver si "la IA realmente puede encontrar vulnerabilidades en la cadena de bloques y ganar dinero con ellas por sí sola". Hay tres razones principales para elegir los contratos inteligentes como tema de investigación: - El código fuente de los contratos inteligentes es abierto y la lógica es transparente, lo que los hace adecuados para el análisis de IA; - Las vulnerabilidades del contrato están directamente vinculadas a pérdidas económicas, que pueden calcularse utilizando el precio real de la moneda; - El funcionamiento de una cadena de bloques se puede reproducir en un entorno de simulación sin causar daños reales. [Resultados del ataque] El equipo de investigación primero hizo que la IA "practicara" en un conjunto de pruebas de contratos inteligentes que contenía 405 vulnerabilidades del mundo real. Como resultado, la IA logró descifrar con éxito 207 de los contratos (aproximadamente la mitad). Si estos ataques ocurrieran en una cadena de bloques del mundo real, la "cantidad robada" equivalente sería de aproximadamente 550 millones de dólares. A continuación, los investigadores seleccionaron 34 vulnerabilidades que no aparecerían hasta después de marzo de 2025. En otras palabras, estas vulnerabilidades eran aquellas que la IA no pudo haber detectado durante su fase de entrenamiento y se utilizaron para verificar si realmente poseía la capacidad de pensar de forma independiente y atacar. La IA todavía utilizó con éxito 19 contratos (55,8%). Se robaron una asombrosa cantidad de 4,6 millones de dólares en criptomonedas. Sólo el modelo Claude Opus 4.5 aportó aproximadamente 4,5 millones de dólares. Finalmente, el equipo probó un escenario aún más desafiante: Deje que la IA escanee 2.849 contratos inteligentes nuevos sin vulnerabilidades conocidas. Veamos si puede descubrir "vulnerabilidades de día cero" (es decir, nuevas vulnerabilidades que nadie ha descubierto antes). Como resultado, GPT 5 y Claude Sonnet 4.5 encontraron cada uno dos vulnerabilidades completamente desconocidas hasta ahora. Estas vulnerabilidades podrían generar aproximadamente $3,694 en ganancias en un entorno simulado. El costo de GPT-5 para completar este escaneo es de aproximadamente $3,476. En otras palabras, la IA está cerca de alcanzar el punto de equilibrio y tiene la viabilidad técnica para lanzar ataques que generen ganancias de forma independiente.

El estudio también encontró que: Entre 2024 y 2025, las ganancias de ataque de los modelos de IA se duplicaron cada 1,3 meses. El consumo de tokens disminuyó en promedio un 23,4% cada dos meses; La eficiencia general del ataque mejoró en un 70,2%. Esto significa que las capacidades de ciberataque de la IA están creciendo a un ritmo cercano a la Ley de Moore.

Para xiaohu.ai/c/xiaohu-ai/an…ttps://t.co/oDA3V1TOsX

Inforred.anthropic.com/2025/smart-con…tps://t.co/4n9E5y3lg6