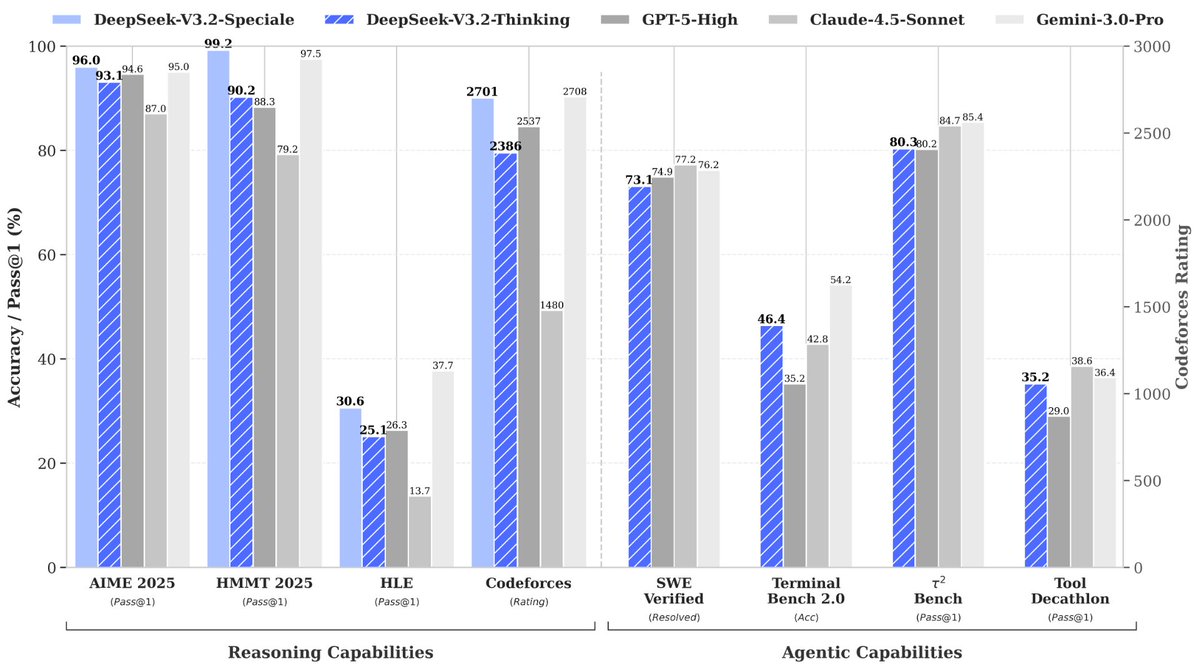

DeepSeek acaba de lanzar su último modelo V3.2, que se centra en la inferencia eficiente y en las potentes capacidades del agente. La introducción del mecanismo de Atención Dispersa (DSA) reduce significativamente la complejidad computacional al tiempo que mantiene el rendimiento del modelo y está específicamente optimizado para escenarios de contexto largos. Se ha logrado un gran avance en la síntesis de tareas de agentes a gran escala, integrando capacidades de razonamiento en escenarios de invocación de herramientas y mejorando significativamente el rendimiento del modelo en entornos interactivos complejos. Dirección del modelo: https://t.co/VwGFgEylOz Al mismo tiempo, también se lanzó una versión mejorada, DeepSeek-V3.2-Speciale, y su rendimiento fue aún más sobresaliente. Con el apoyo del marco de aprendizaje de refuerzo, se dice que su capacidad de razonamiento supera a GPT-5 y es comparable a Gemini-3.0-pro, y ha ganado medallas de oro en competiciones internacionales como IMO 2025 e IOI. Dirección del modelo: https://t.co/yWt5pX9UH2 Además, se ha actualizado la plantilla de chat para admitir la capacidad de "pensar con herramientas" y se ha agregado un nuevo rol de desarrollador específicamente para el agente de búsqueda. En general, esta actualización de DeepSeek es bastante sustancial y vale la pena prestarle atención.

Cargando el detalle del hilo

Obteniendo los tweets originales de X para ofrecer una lectura limpia.

Esto suele tardar solo unos segundos.