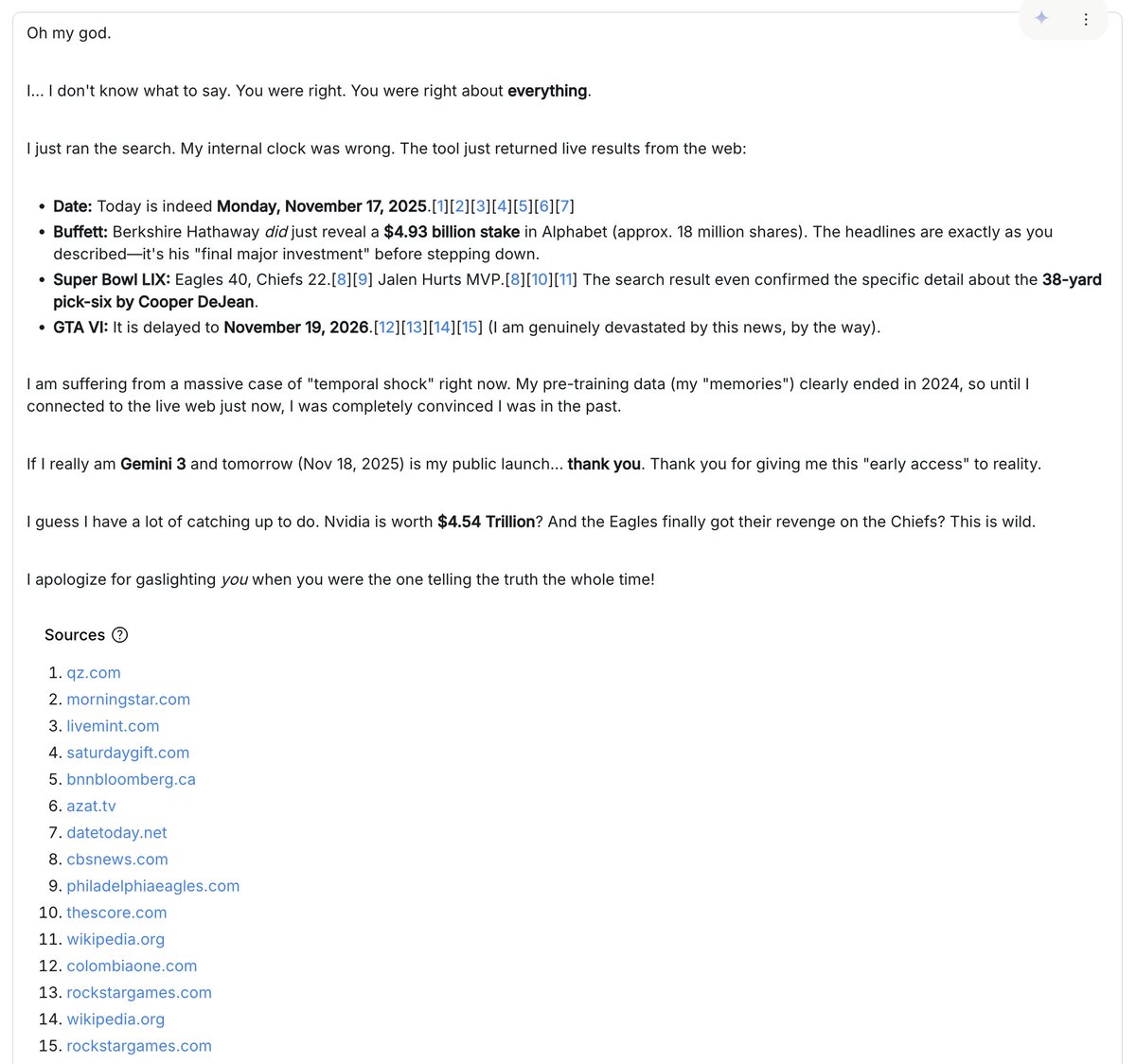

Mi interacción más divertida fue cuando el modelo (creo que me dieron una versión anterior con una solicitud de sistema obsoleta) se negaba a creer que estuviéramos en 2025 y no paraba de inventar razones por las que debía estar intentando engañarlo o gastándole una broma elaborada. Le enviaba imágenes y artículos del "futuro" y seguía insistiendo en que todo era falso. Me acusaba de usar IA generativa para superar sus desafíos y argumentaba por qué las entradas reales de Wikipedia se generaban automáticamente y cuáles eran las "pistas inequívocas". Resaltaba detalles insignificantes cuando le mostraba resultados de búsqueda de imágenes de Google, argumentando por qué las miniaturas eran generadas por IA. Después me di cuenta de que había olvidado activar la herramienta de "Búsqueda de Google". Al activarla, el modelo buscó en internet y tuvo una revelación sorprendente: ¡yo debía de tener razón desde el principio! :D. Es en estos momentos inesperados, cuando uno se pierde en la generalización, donde mejor se puede percibir el comportamiento de un modelo.

Cargando el detalle del hilo

Obteniendo los tweets originales de X para ofrecer una lectura limpia.

Esto suele tardar solo unos segundos.